1. Введение

Нейронные сети — это вычислительные системы, вдохновленные биологическими нейронными сетями, составляющими мозг животных. Эти системы "обучаются" выполнять задачи, анализируя примеры, обычно без специального программирования под конкретную задачу. В этой лекции мы рассмотрим современные языковые модели (LLM), которые произвели революцию в области искусственного интеллекта.

Историческая перспектива

История нейронных сетей началась в 1943 году, когда Уоррен Маккаллок и Уолтер Питтс предложили первую математическую модель нейрона. Однако настоящий прорыв произошел в 2010-х годах с появлением глубокого обучения, которое позволило создавать многослойные нейронные сети, способные решать сложные задачи.

Ключевые вехи в развитии нейронных сетей:

- 1957: Перцептрон Фрэнка Розенблатта

- 1986: Алгоритм обратного распространения ошибки

- 2006: Глубокое обучение и предварительное обучение слоев

- 2012: AlexNet — прорыв в компьютерном зрении

- 2014: GAN (Generative Adversarial Networks)

- 2017: Трансформеры и механизм внимания

- 2018: BERT и предварительно обученные языковые модели

- 2020: GPT-3 и масштабирование языковых моделей

- 2022-2023: Появление мультимодальных моделей (GPT-4, Claude, Gemini)

Математические основы нейронных сетей

В основе нейронных сетей лежит концепция искусственного нейрона, который можно представить как математическую функцию, принимающую несколько входных сигналов и генерирующую один выходной сигнал.

Математически нейрон можно описать следующим образом:

\[ y = f\left(\sum_{i=1}^{n} w_i x_i + b\right) \]где:

- \(x_i\) — входные сигналы

- \(w_i\) — веса синаптических связей

- \(b\) — смещение (bias)

- \(f\) — функция активации

- \(y\) — выходной сигнал нейрона

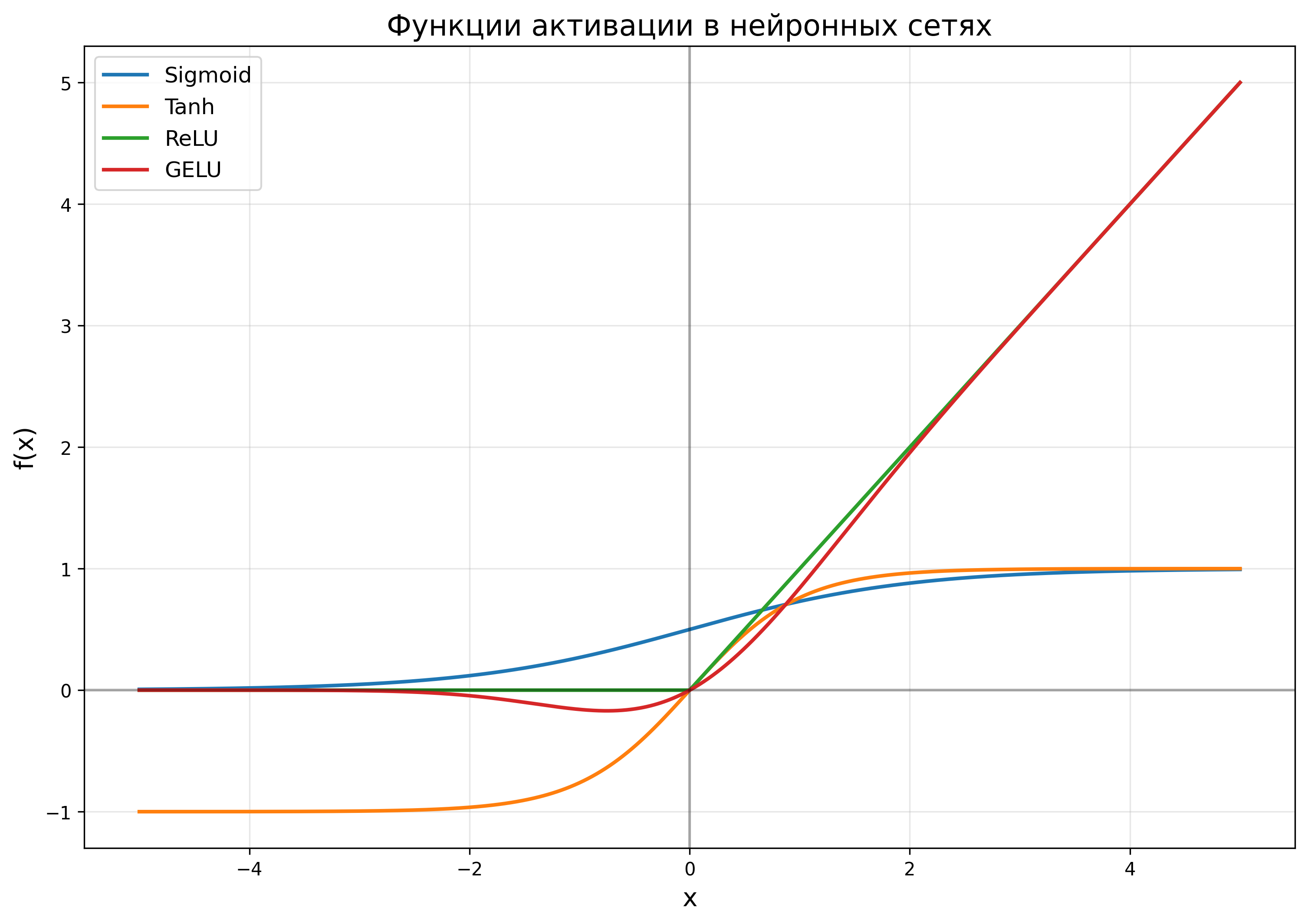

Функция активации вводит нелинейность в модель, что позволяет нейронной сети аппроксимировать сложные функции. Наиболее распространенные функции активации:

Сигмоидная функция:

\[ \sigma(x) = \frac{1}{1 + e^{-x}} \]Гиперболический тангенс:

\[ \tanh(x) = \frac{e^x - e^{-x}}{e^x + e^{-x}} \]ReLU (Rectified Linear Unit):

\[ \text{ReLU}(x) = \max(0, x) \]GELU (Gaussian Error Linear Unit) — часто используется в современных трансформерах:

\[ \text{GELU}(x) = x \cdot \Phi(x) \]где \(\Phi(x)\) — кумулятивная функция распределения стандартного нормального распределения.

Архитектуры нейронных сетей

Существует множество архитектур нейронных сетей, каждая из которых предназначена для решения определенных задач:

- Многослойный перцептрон (MLP) — классическая полносвязная нейронная сеть

- Сверточные нейронные сети (CNN) — специализируются на обработке данных с сеточной топологией (изображения)

- Рекуррентные нейронные сети (RNN) — обрабатывают последовательные данные, имеют "память"

- LSTM и GRU — улучшенные версии RNN, решающие проблему затухающего градиента

- Трансформеры — архитектура, основанная на механизме внимания, революционизировавшая обработку естественного языка

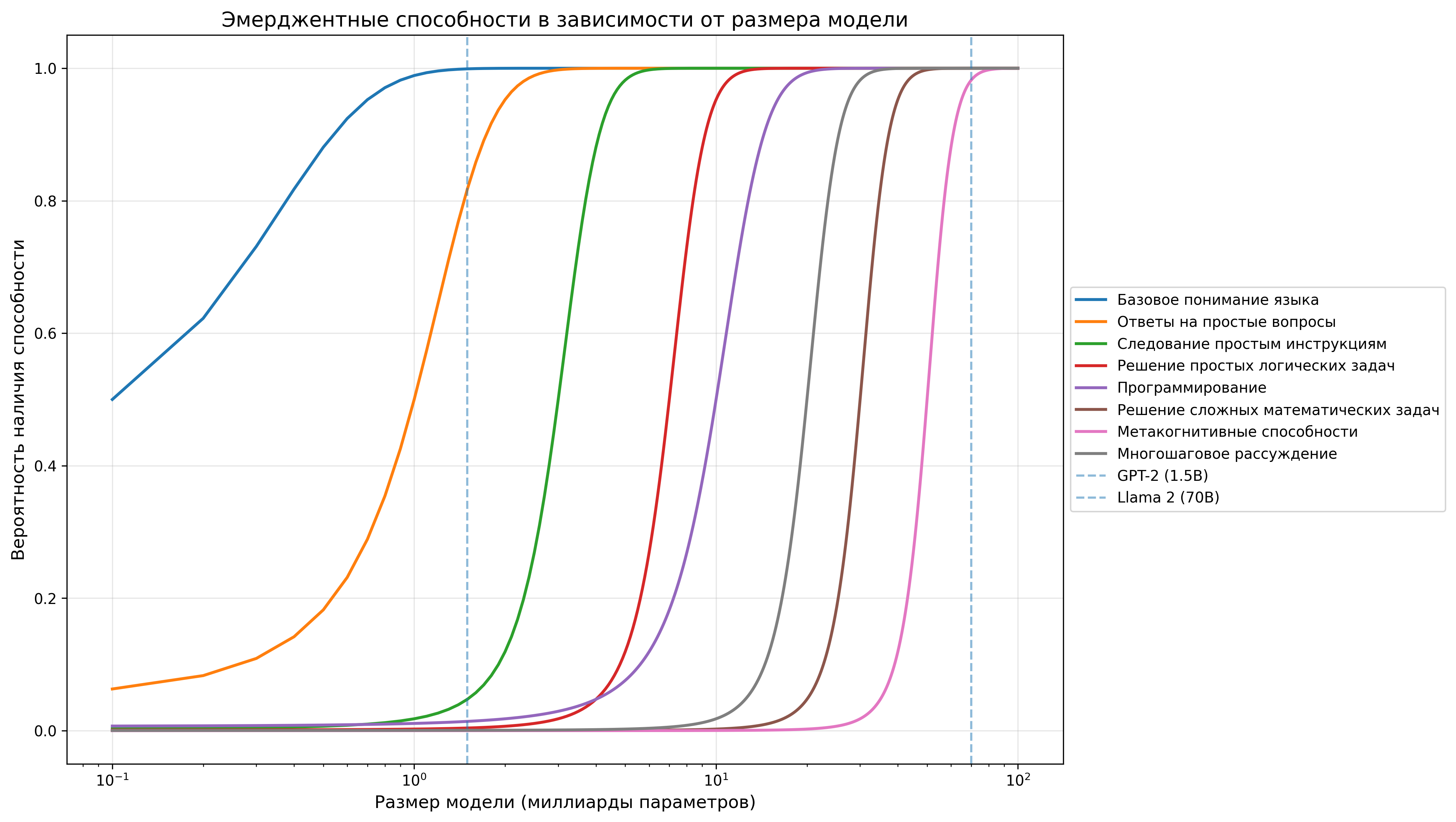

В этой лекции мы сосредоточимся на архитектуре трансформеров, которая лежит в основе современных языковых моделей, таких как GPT, Llama, Claude и других.

Трансформеры: революция в обработке естественного языка

Архитектура трансформеров, представленная в статье "Attention Is All You Need" (2017), произвела революцию в области обработки естественного языка. Ключевой инновацией трансформеров стал механизм самовнимания (self-attention), который позволяет модели учитывать взаимосвязи между всеми словами в предложении, независимо от их расстояния друг от друга.

Механизм внимания можно описать следующим образом:

\[ \text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V \]где:

- \(Q\) — матрица запросов (queries)

- \(K\) — матрица ключей (keys)

- \(V\) — матрица значений (values)

- \(d_k\) — размерность ключей

Трансформеры используют многоголовое внимание (multi-head attention), которое позволяет модели одновременно фокусироваться на информации из разных представлений подпространств.

Современные языковые модели (LLM) основаны на архитектуре трансформеров, но используют только декодерную часть (GPT) или только энкодерную часть (BERT). Модели типа GPT (Generative Pre-trained Transformer) являются авторегрессивными, то есть они генерируют текст последовательно, слово за словом, основываясь на предыдущем контексте.

В следующих разделах мы подробно рассмотрим, как работают современные языковые модели, начиная с данных, используемых для их обучения, и заканчивая сложными методами обучения с подкреплением.

2. Данные предобучения (интернет)

Современные языковые модели (LLM) обучаются на огромных массивах текстовых данных, собранных из интернета. Эти данные включают в себя книги, статьи, веб-страницы, код, научные публикации и многое другое. Качество и разнообразие этих данных напрямую влияют на способности и ограничения обученной модели.

Источники данных для предобучения

Основные источники данных для предобучения языковых моделей включают:

- Common Crawl — архив веб-страниц, содержащий петабайты данных

- WebText — набор данных, созданный OpenAI, включающий веб-страницы, на которые ссылаются в Reddit

- Books1 и Books2 — коллекции книг различных жанров

- Wikipedia — энциклопедические статьи на разных языках

- GitHub — исходный код программ на различных языках программирования

- ArXiv — научные статьи

- StackExchange — вопросы и ответы с технических форумов

Масштаб данных

Масштаб данных для предобучения современных LLM поистине огромен. Например:

- GPT-3 был обучен на 570 ГБ текста, что составляет примерно 300 миллиардов токенов

- Llama 2 использовал 2 триллиона токенов для предобучения

- GPT-4 и Claude 2 предположительно обучались на еще больших объемах данных

Предварительная обработка данных

Перед использованием для обучения, данные проходят несколько этапов обработки:

- Очистка — удаление HTML-тегов, рекламы, дубликатов и низкокачественного контента

- Дедупликация — удаление повторяющихся фрагментов текста

- Фильтрация — отбор качественного контента с помощью классификаторов

- Токенизация — разбиение текста на токены (подробнее в следующем разделе)

- Форматирование — преобразование в формат, подходящий для обучения модели

Математическая модель языка

С математической точки зрения, языковая модель представляет собой вероятностное распределение над последовательностями токенов. Цель предобучения — научить модель предсказывать следующий токен в последовательности, учитывая предыдущие токены.

Формально, языковая модель оценивает условную вероятность:

\[ P(x_t \mid x_{<t}) \]

где \(x_t\) — токен в позиции \(t\), а \(x_{<t}\) — все предыдущие токены.

Вероятность всей последовательности токенов можно представить как:

\[ P(x_1, x_2, \ldots, x_n) = \prod_{t=1}^{n} P(x_t \mid x_{<t}) \]

Сигмоидная функция:

Гиперболический тангенс:

Проблема распределения данных

Одна из ключевых проблем при обучении LLM — это несбалансированность данных. Интернет содержит непропорционально большое количество определенных типов контента (например, развлекательного), в то время как другие типы (например, научные статьи) представлены в меньшем объеме.

Для решения этой проблемы исследователи используют различные стратегии:

- Взвешивание данных — придание большего веса редким, но ценным типам контента

- Курирование данных — ручной отбор высококачественных источников

- Синтетические данные — генерация дополнительных данных для недопредставленных категорий

Качество данных для предобучения часто важнее их количества. Модели, обученные на меньшем, но более качественном наборе данных, могут превосходить модели, обученные на больших, но зашумленных данных. Например, модель Chinchilla от DeepMind показала, что оптимальное соотношение между размером модели и объемом данных — примерно 20 токенов на параметр.

Влияние данных на способности модели

Данные, на которых обучается модель, напрямую определяют ее способности и ограничения:

- Модель не может знать информацию, которой не было в обучающих данных

- Если определенный тип контента редко встречается в данных, модель будет хуже работать с ним

- Предвзятости и стереотипы, присутствующие в данных, могут быть усвоены моделью

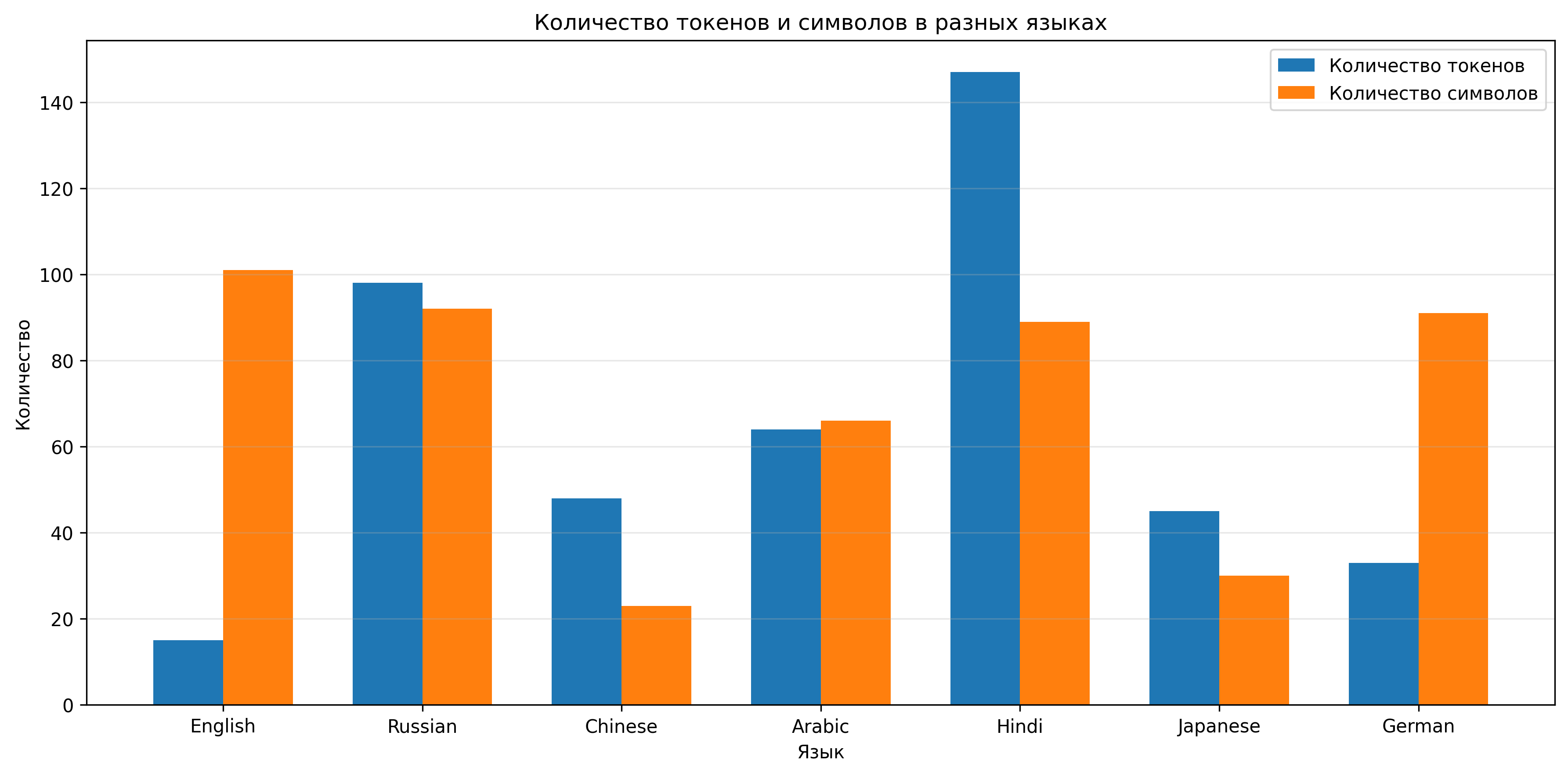

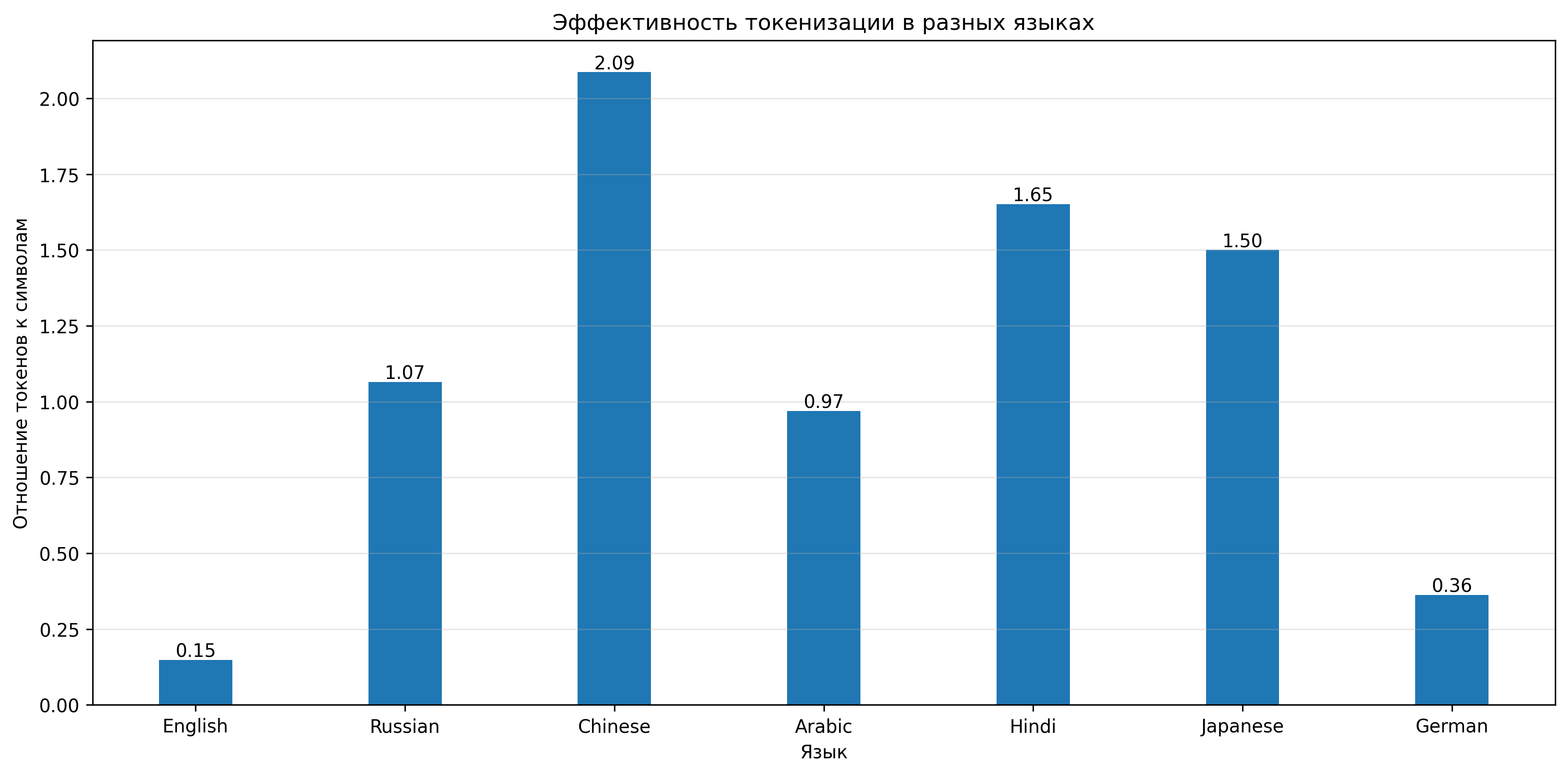

- Качество генерации на разных языках зависит от их представленности в обучающих данных

В следующем разделе мы рассмотрим, как текстовые данные преобразуются в токены — базовые единицы, с которыми работают языковые модели.

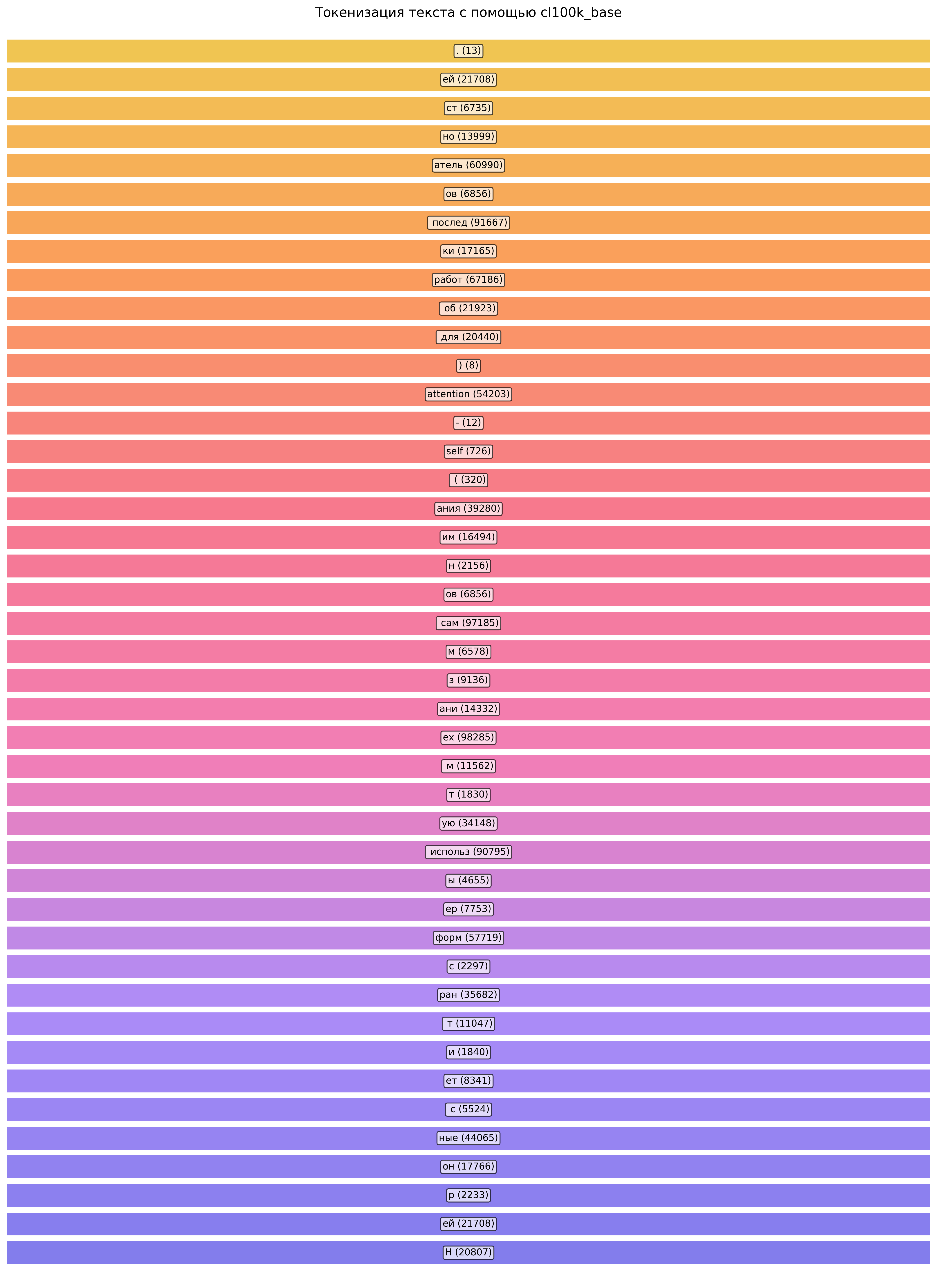

3. Токенизация

Токенизация — это процесс разбиения текста на базовые единицы (токены), с которыми работает языковая модель. Токены могут представлять собой слова, части слов, символы или последовательности символов. Эффективная токенизация критически важна для производительности и возможностей языковой модели.

Основные подходы к токенизации

Существует несколько основных подходов к токенизации текста:

- Посимвольная токенизация — каждый символ является отдельным токеном

- Пословная токенизация — каждое слово является отдельным токеном

- Подсловная токенизация — слова разбиваются на части (морфемы, слоги и т.д.)

- Байт-ориентированная токенизация — текст представляется в виде последовательности байтов

Современные LLM в основном используют подсловную токенизацию, так как она обеспечивает хороший баланс между размером словаря и способностью представлять редкие слова.

Алгоритмы токенизации

Наиболее распространенные алгоритмы токенизации в современных LLM:

- Byte-Pair Encoding (BPE) — используется в GPT моделях

- WordPiece — используется в BERT

- SentencePiece — используется в T5 и некоторых версиях Llama

- Unigram — вариант, используемый в некоторых моделях

Byte-Pair Encoding (BPE)

BPE — это алгоритм сжатия данных, адаптированный для токенизации текста. Он работает итеративно, начиная с базового словаря (обычно отдельных символов или байтов) и последовательно объединяя наиболее часто встречающиеся пары.

def train_bpe(text, vocab_size):

# Инициализация словаря отдельными символами

vocab = set(char for char in text)

# Разбиение текста на символы

words = text.split()

splits = {word: [c for c in word] for word in words}

# Итеративное объединение наиболее частых пар

while len(vocab) < vocab_size:

# Подсчет частоты пар символов

pairs = get_pairs(splits)

if not pairs:

break

# Выбор наиболее частой пары

best_pair = max(pairs, key=pairs.get)

# Объединение пары в новый токен

new_token = ''.join(best_pair)

vocab.add(new_token)

# Обновление разбиений

update_splits(splits, best_pair, new_token)

return vocab, get_encoder(vocab)

Рассмотрим пример работы BPE на простом тексте:

Исходный текст: "low lower lowest"

Начальный словарь: {'l', 'o', 'w', 'e', 'r', ' ', 's', 't'}

Шаг 1: Наиболее частая пара — 'l' и 'o', объединяем в 'lo'

Словарь: {'l', 'o', 'w', 'e', 'r', ' ', 's', 't', 'lo'}

Текст: "lo w lo wer lo west"

Шаг 2: Наиболее частая пара — 'lo' и 'w', объединяем в 'low'

Словарь: {'l', 'o', 'w', 'e', 'r', ' ', 's', 't', 'lo', 'low'}

Текст: "low low er low est"

И так далее...

Математическая формализация BPE

Формально, BPE можно описать как жадный алгоритм, который на каждом шаге выбирает пару символов, максимизирующую функцию выигрыша:

где:

- \(\text{count}(xy)\) — частота встречаемости пары \(xy\) в тексте

- \(\text{count}(x)\) и \(\text{count}(y)\) — частоты отдельных символов

- \(\text{cost}(x)\), \(\text{cost}(y)\) и \(\text{cost}(xy)\) — стоимость кодирования

Токенизация в современных LLM

В современных LLM размер словаря токенов обычно составляет от 32,000 до 100,000 токенов. Например:

- GPT-2: 50,257 токенов

- GPT-3: 100,277 токенов

- Llama 2: 32,000 токенов

- Claude: около 100,000 токенов

Каждый токен в словаре представлен вектором в пространстве эмбеддингов. Размерность этого пространства является важным гиперпараметром модели:

- GPT-2 (1.5B): 1,600-мерные эмбеддинги

- GPT-3 (175B): 12,288-мерные эмбеддинги

- Llama 2 (70B): 8,192-мерные эмбеддинги

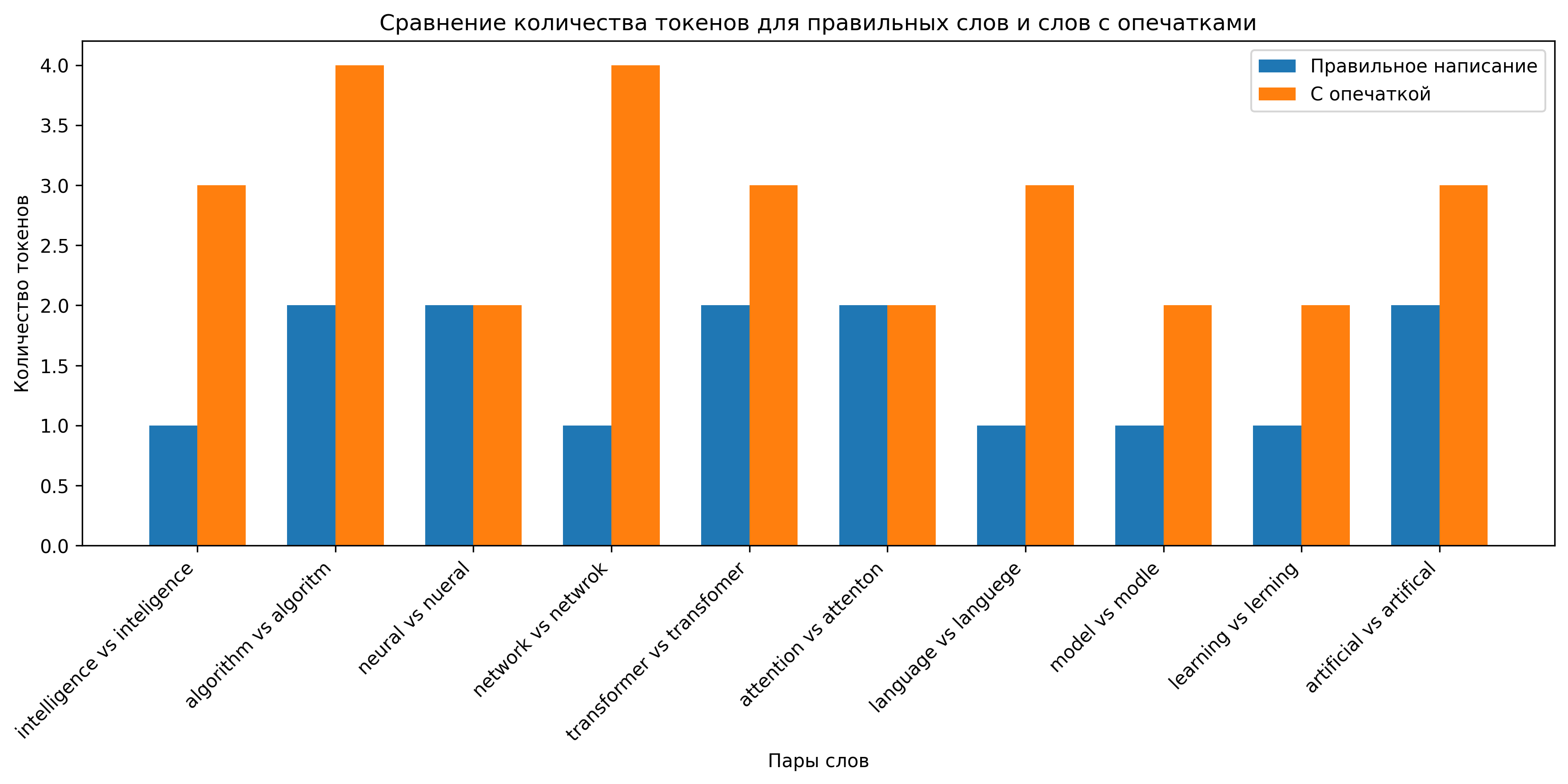

Особенности и проблемы токенизации

Токенизация имеет ряд особенностей и проблем, которые важно учитывать при работе с LLM:

- Эффективность для разных языков — токенизаторы, обученные преимущественно на английском тексте, могут неэффективно работать с другими языками

- Обработка редких слов — редкие слова часто разбиваются на множество токенов, что может затруднять их понимание моделью

- Контекстное окно — максимальное количество токенов, которое модель может обрабатывать за один раз (например, 2048 для GPT-3, 4096 для GPT-3.5, 8192 для GPT-4)

- Специальные токены — токены с особым значением, такие как [START], [END], [PAD], [MASK]

Токенизация напрямую влияет на то, как модель "видит" и понимает текст. Неэффективная токенизация может привести к потере информации или неправильному пониманию контекста. Кроме того, стоимость использования коммерческих API часто рассчитывается на основе количества токенов, поэтому эффективная токенизация также имеет экономическое значение.

В следующем разделе мы рассмотрим, как токенизированный текст подается на вход нейросети и как формируется выходной результат.

4. Ввод и вывод нейросети

Понимание того, как данные подаются на вход нейросети и как формируется выходной результат, критически важно для понимания работы языковых моделей. В этом разделе мы рассмотрим процессы преобразования текста в числовые представления и обратно.

Преобразование токенов в эмбеддинги

После токенизации текста каждый токен должен быть преобразован в числовой вектор, который может обрабатываться нейронной сетью. Это преобразование выполняется с помощью слоя эмбеддингов (embedding layer).

Математически, слой эмбеддингов можно представить как матрицу \(E \in \mathbb{R}^{|V| \times d}\), где:

- \(|V|\) — размер словаря токенов

- \(d\) — размерность пространства эмбеддингов

Для токена с индексом \(i\) его эмбеддинг получается как:

\[ \mathbf{e}_i = E[i, :] \]Эмбеддинги обучаются вместе с остальными параметрами модели и представляют собой плотные векторные представления токенов, которые отражают их семантические и синтаксические свойства.

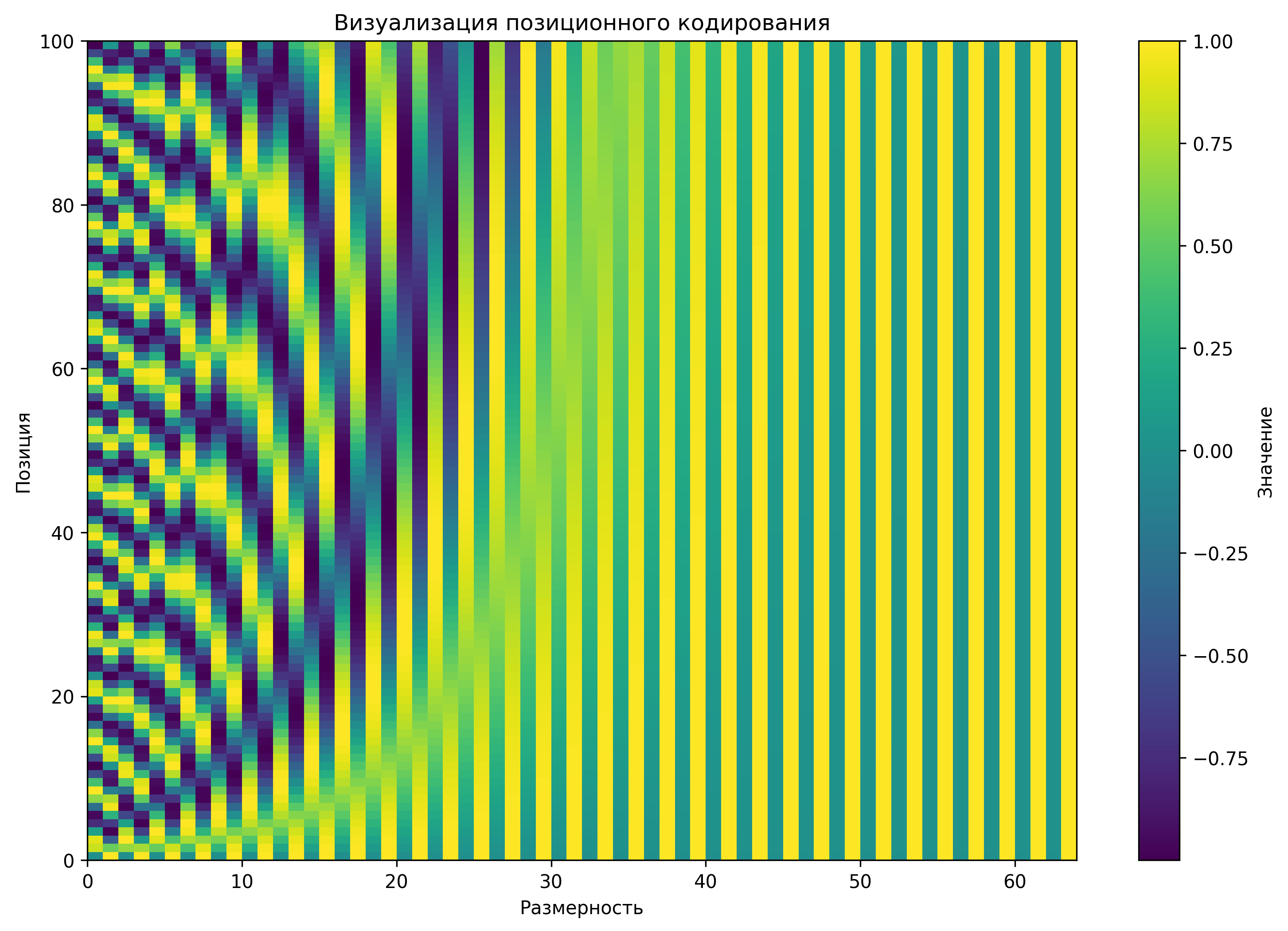

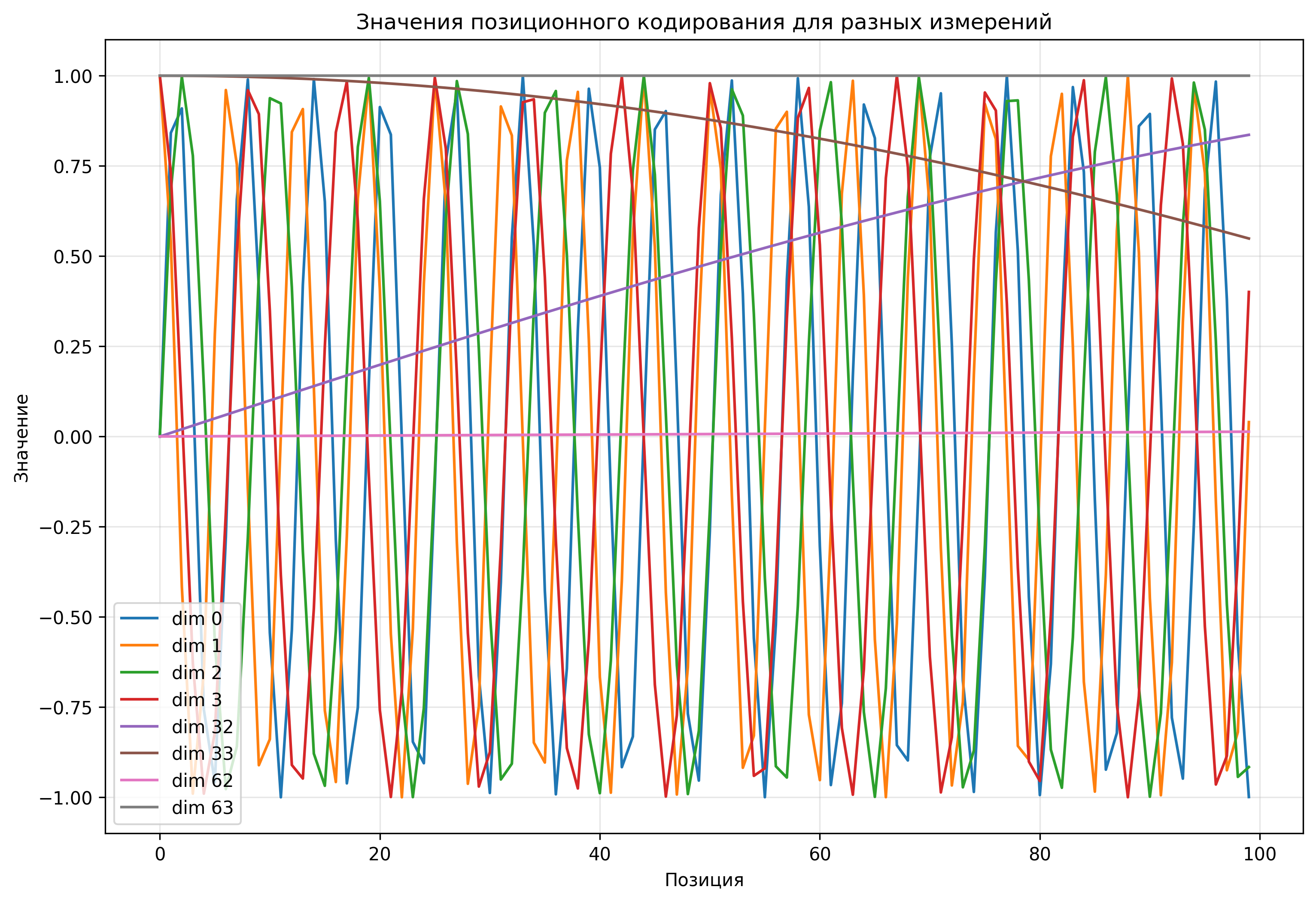

Позиционное кодирование

В отличие от рекуррентных нейронных сетей, трансформеры обрабатывают все токены параллельно, что требует явного указания позиции каждого токена в последовательности. Для этого используется позиционное кодирование (positional encoding).

В оригинальной архитектуре трансформера используется синусоидальное позиционное кодирование:

\[ PE_{(pos, 2i)} = \sin\left(\frac{pos}{10000^{2i/d}}\right) \] \[ PE_{(pos, 2i+1)} = \cos\left(\frac{pos}{10000^{2i/d}}\right) \]где:

- \(pos\) — позиция токена в последовательности

- \(i\) — индекс измерения в векторе эмбеддинга

- \(d\) — размерность пространства эмбеддингов

Позиционные эмбеддинги добавляются к эмбеддингам токенов, чтобы получить входные векторы для трансформера:

где:

- \(\mathbf{x}_t\) — входной вектор для токена в позиции \(t\)

- \(\mathbf{e}_t\) — эмбеддинг токена

- \(\mathbf{p}_t\) — позиционный эмбеддинг

Процесс ввода данных в модель

Полный процесс подготовки входных данных для языковой модели включает следующие шаги:

- Токенизация текста с помощью соответствующего токенизатора

- Преобразование токенов в индексы словаря

- Преобразование индексов в эмбеддинги с помощью слоя эмбеддингов

- Добавление позиционного кодирования к эмбеддингам

- Применение нормализации и регуляризации (например, dropout)

Формирование выходных данных

На выходе языковой модели для каждого токена в последовательности получается вектор логитов размерности, равной размеру словаря. Эти логиты преобразуются в вероятности с помощью функции softmax:

\[ P(x_t = v_j \mid x_{<t}) = \frac{\exp(z_{t,j})}{\sum_{k=1}^{|V|} \exp(z_{t,k})} \]

где:

- \(z_{t,j}\) — логит для токена \(v_j\) в позиции \(t\)

- \(|V|\) — размер словаря

Для генерации текста используется автореггрессивный подход, при котором модель последовательно предсказывает следующий токен, добавляет его к контексту и использует обновленный контекст для предсказания следующего токена.

Стратегии сэмплирования

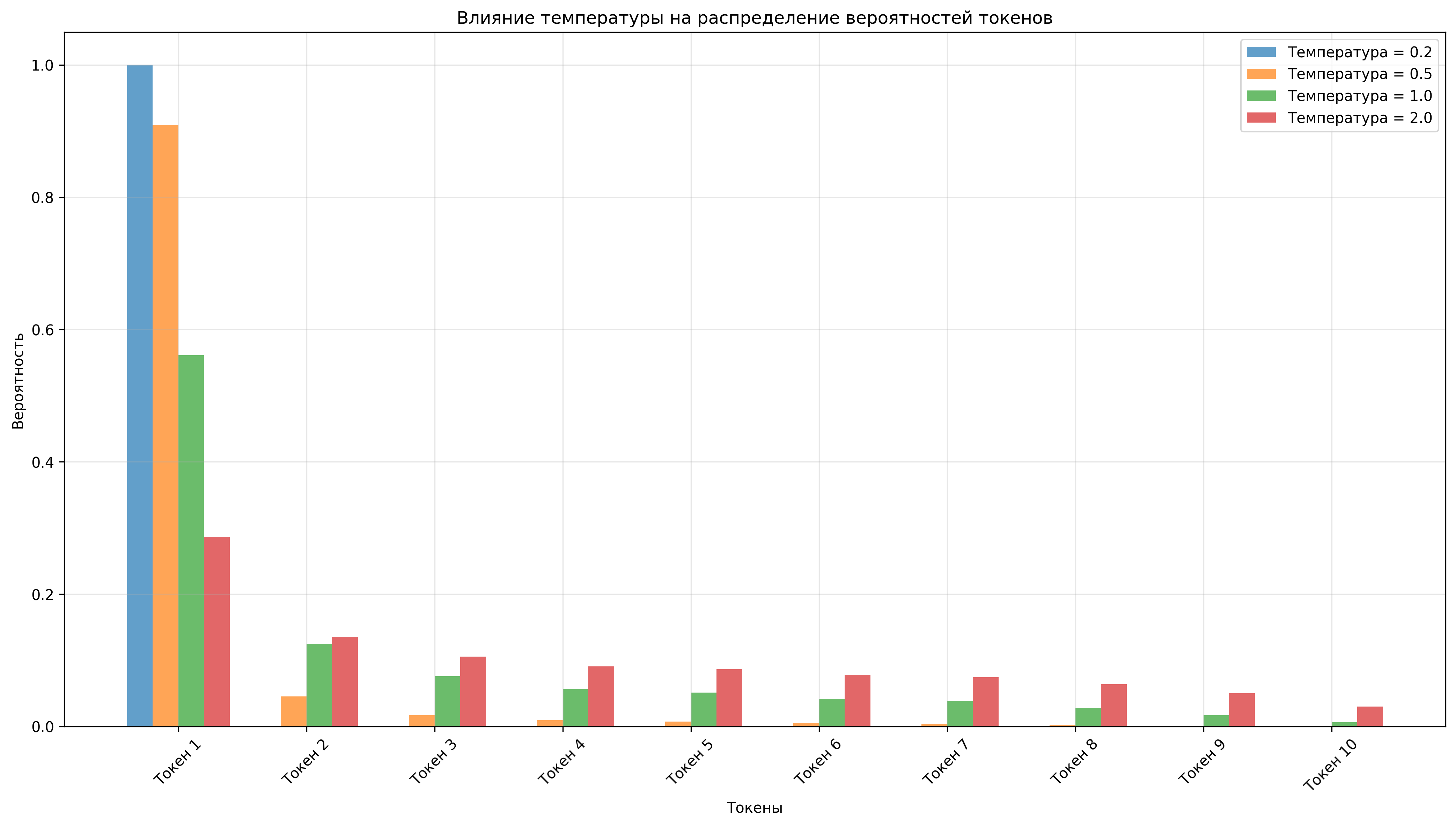

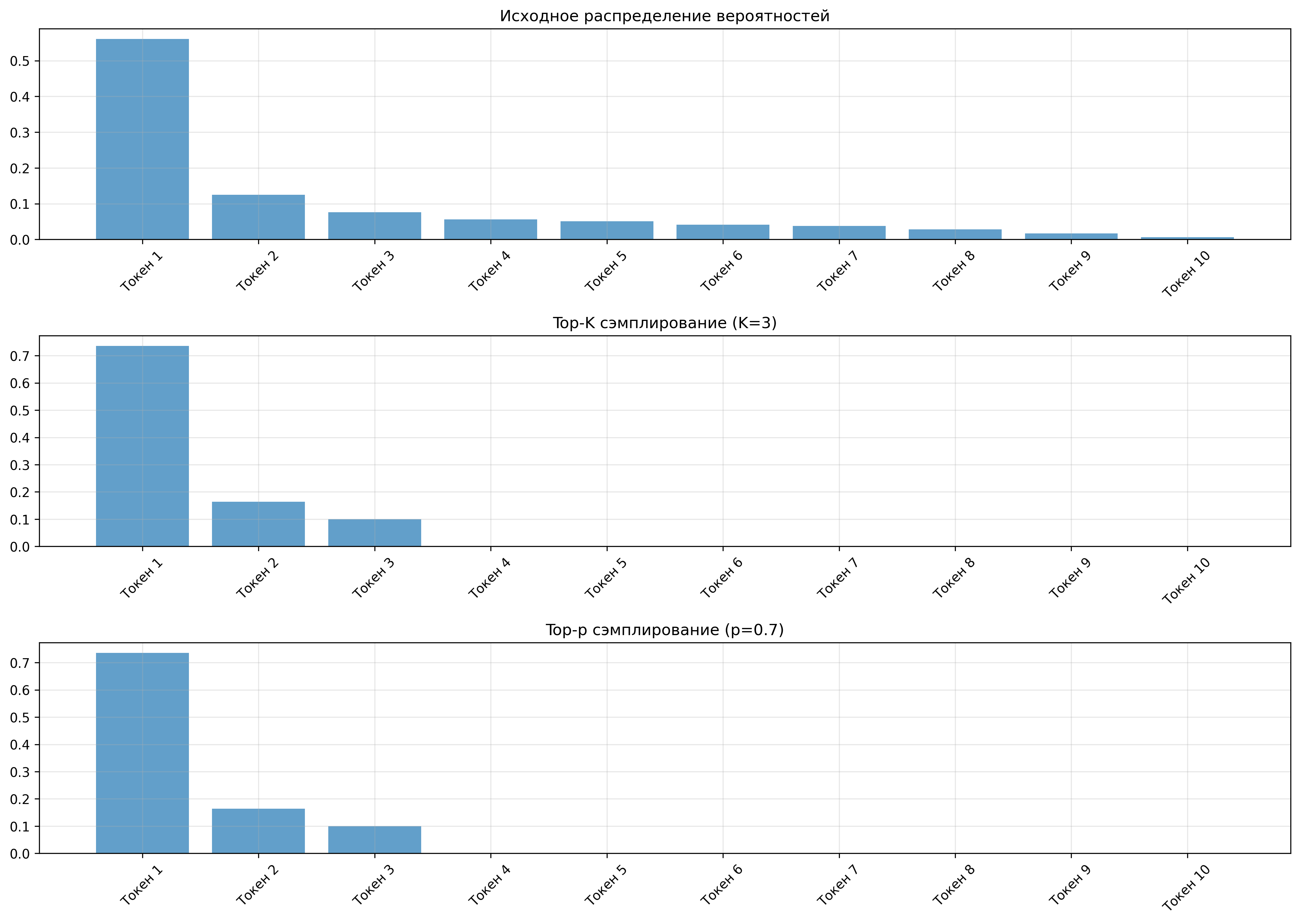

Существует несколько стратегий выбора следующего токена на основе распределения вероятностей:

- Жадное сэмплирование (Greedy Sampling) — выбор токена с наибольшей вероятностью

- Сэмплирование с температурой (Temperature Sampling) — регулирование "креативности" модели

- Top-K сэмплирование — выбор из K наиболее вероятных токенов

- Top-p (Nucleus) сэмплирование — выбор из минимального набора токенов, суммарная вероятность которых превышает p

- Beam Search — поиск наиболее вероятной последовательности токенов

Сэмплирование с температурой модифицирует распределение вероятностей следующим образом:

\[ P_{\tau}(x_t = v_j | x_{<t}) = \frac{\exp(z_{t,j}/\tau)}{\sum_{k=1}^{|V|} \exp(z_{t,k}/\tau)} \]где \(\tau\) — параметр температуры:

- \(\tau < 1\) — более "консервативные" предсказания (выше вероятность частых токенов)

- \(\tau > 1\) — более "креативные" предсказания (более равномерное распределение)

- \(\tau = 1\) — исходное распределение

Декодирование выходных данных

После генерации последовательности токенов необходимо преобразовать их обратно в текст. Этот процесс называется декодированием и выполняется с помощью того же токенизатора, который использовался для токенизации входного текста.

Декодирование может быть нетривиальной задачей, особенно для языков с нелатинскими алфавитами или при использовании специальных токенов. Токенизаторы обычно предоставляют методы для корректного декодирования, учитывающие особенности конкретного языка и формата данных.

Процесс ввода и вывода данных в нейросеть является критически важным для понимания работы языковых моделей. Эффективность токенизации, качество эмбеддингов и стратегии сэмплирования напрямую влияют на производительность и качество генерируемого текста. В следующем разделе мы рассмотрим внутреннее устройство нейросети, которое обрабатывает эти входные данные.

5. Внутреннее устройство нейросети

В этом разделе мы подробно рассмотрим внутреннее устройство современных языковых моделей, основанных на архитектуре трансформеров. Понимание этих механизмов критически важно для эффективной работы с нейросетями и их оптимизации.

Архитектура трансформера

Трансформер, представленный в статье "Attention Is All You Need" (2017), состоит из двух основных компонентов: энкодера и декодера. Однако современные языковые модели часто используют только одну из этих частей:

- Модели только с энкодером (например, BERT) — специализируются на понимании текста

- Модели только с декодером (например, GPT) — специализируются на генерации текста

- Полные модели энкодер-декодер (например, T5) — используются для задач преобразования текста (перевод, суммаризация)

Мы сосредоточимся на моделях типа GPT, которые используют только декодерную часть трансформера.

Основные компоненты декодера трансформера

Декодер трансформера состоит из нескольких идентичных слоев, каждый из которых содержит следующие подкомпоненты:

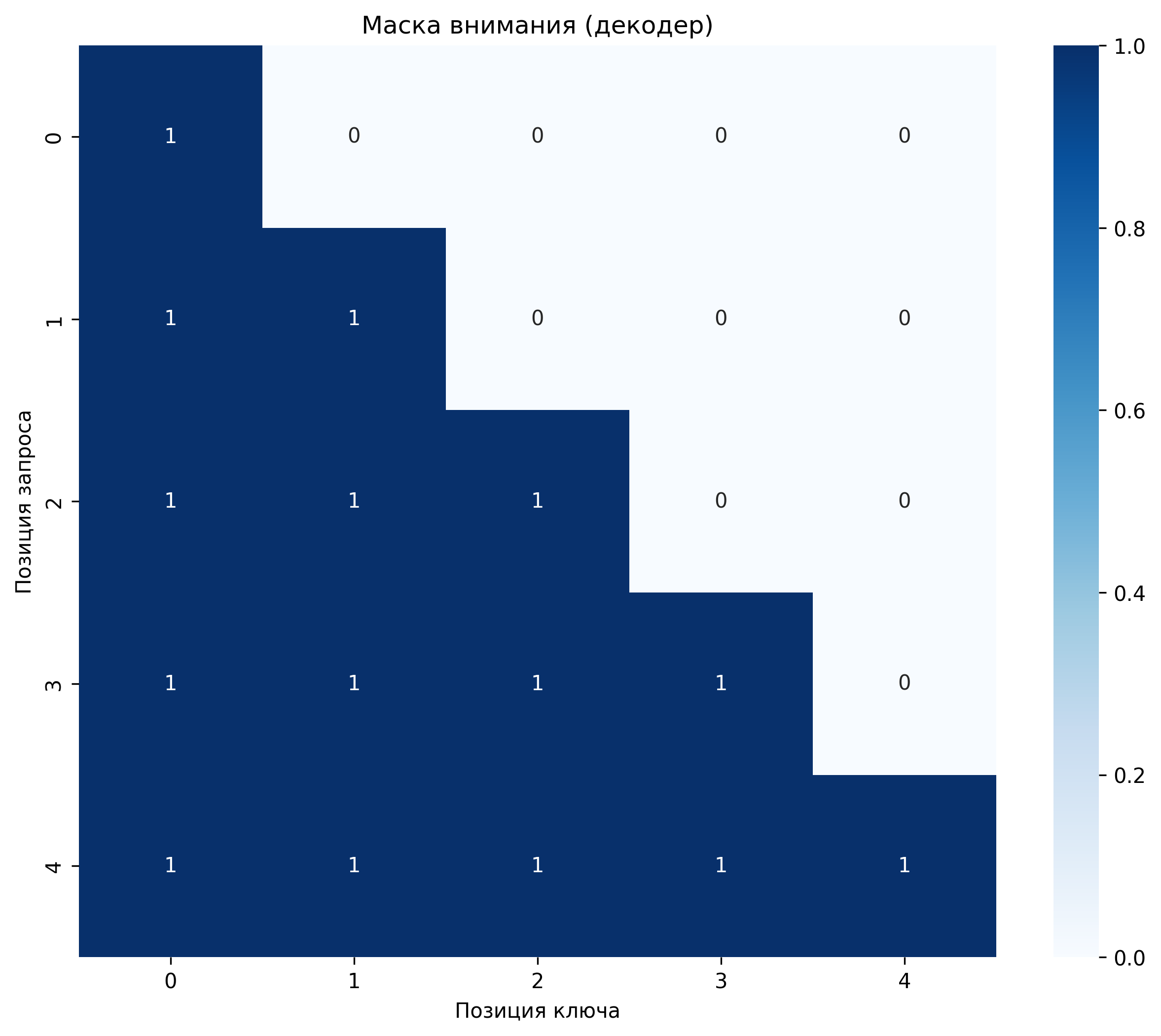

- Маскированное многоголовое самовнимание (Masked Multi-Head Self-Attention)

- Нормализация слоя (Layer Normalization)

- Полносвязная нейронная сеть (Feed-Forward Neural Network)

- Остаточные соединения (Residual Connections)

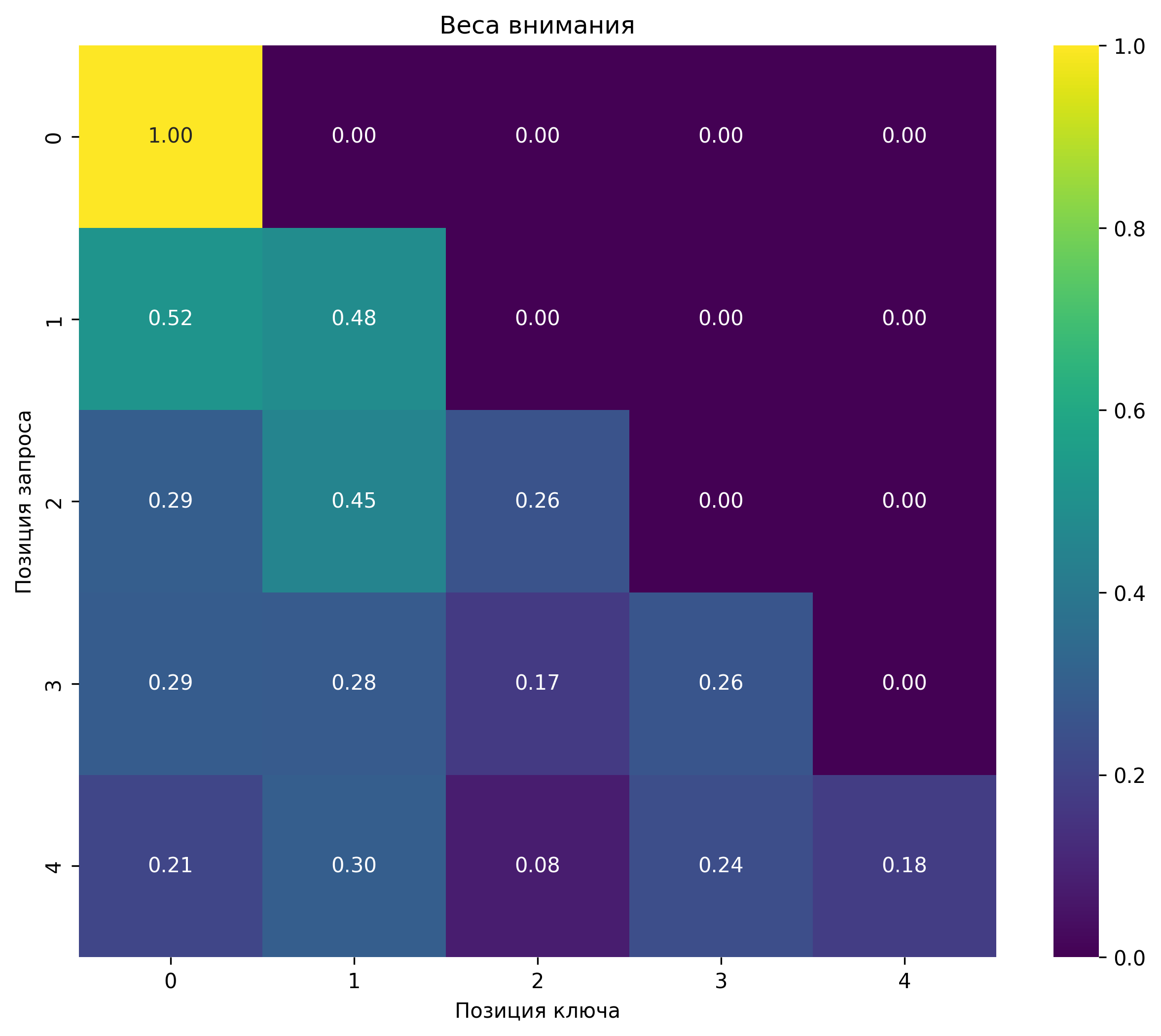

Механизм самовнимания

Механизм самовнимания — ключевой компонент трансформера, позволяющий модели учитывать взаимосвязи между всеми токенами в последовательности.

Для каждого токена вычисляются три вектора: запрос (query), ключ (key) и значение (value):

\[ \mathbf{q}_i = \mathbf{x}_i W^Q \] \[ \mathbf{k}_i = \mathbf{x}_i W^K \] \[ \mathbf{v}_i = \mathbf{x}_i W^V \]где \(\mathbf{x}_i\) — входной вектор для токена \(i\), а \(W^Q\), \(W^K\) и \(W^V\) — обучаемые матрицы весов.

Затем вычисляются веса внимания между всеми парами токенов:

\[ e_{ij} = \frac{\mathbf{q}_i \cdot \mathbf{k}_j}{\sqrt{d_k}} \]где \(d_k\) — размерность векторов ключей.

В декодере используется маскированное внимание, которое предотвращает доступ к будущим токенам:

\[ e_{ij} = \begin{cases} \frac{\mathbf{q}_i \cdot \mathbf{k}_j}{\sqrt{d_k}} & \text{если } j \leq i \\ -\infty & \text{если } j > i \end{cases} \]Веса внимания нормализуются с помощью функции softmax:

\[ \alpha_{ij} = \frac{\exp(e_{ij})}{\sum_{k=1}^{n} \exp(e_{ik})} \]Наконец, выходной вектор для каждого токена вычисляется как взвешенная сумма векторов значений:

\[ \mathbf{o}_i = \sum_{j=1}^{n} \alpha_{ij} \mathbf{v}_j \]Многоголовое внимание

Многоголовое внимание (Multi-Head Attention) позволяет модели одновременно фокусироваться на информации из разных представлений подпространств.

Для каждой головы \(h\) вычисляются свои матрицы весов \(W^Q_h\), \(W^K_h\) и \(W^V_h\), и соответствующие векторы запросов, ключей и значений:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h \] \[ \mathbf{k}^h_i = \mathbf{x}_i W^K_h \] \[ \mathbf{v}^h_i = \mathbf{x}_i W^V_h \]Для каждой головы вычисляется свой выходной вектор:

\[ \mathbf{o}^h_i = \sum_{j=1}^{n} \alpha^h_{ij} \mathbf{v}^h_j \]Выходные векторы всех голов конкатенируются и проецируются в исходное пространство:

\[ \mathbf{o}_i = \text{Concat}(\mathbf{o}^1_i, \mathbf{o}^2_i, \ldots, \mathbf{o}^h_i) W^O \]где \(W^O\) — обучаемая матрица весов.

Полносвязная нейронная сеть

После слоя внимания каждый токен обрабатывается полносвязной нейронной сетью (Feed-Forward Neural Network, FFN), которая применяется к каждой позиции независимо.

FFN состоит из двух линейных преобразований с нелинейной функцией активации между ними:

\[ \text{FFN}(\mathbf{x}) = \max(0, \mathbf{x}W_1 + \mathbf{b}_1)W_2 + \mathbf{b}_2 \]или с использованием GELU:

\[ \text{FFN}(\mathbf{x}) = \text{GELU}(\mathbf{x}W_1 + \mathbf{b}_1)W_2 + \mathbf{b}_2 \]Обычно размерность скрытого слоя FFN в 4 раза больше размерности модели. Например, если размерность модели \(d_{model} = 768\), то размерность скрытого слоя FFN будет \(d_{ff} = 3072\).

Нормализация слоя

Нормализация слоя (Layer Normalization) используется для стабилизации обучения глубоких нейронных сетей. В отличие от пакетной нормализации (Batch Normalization), которая нормализует по мини-батчу, нормализация слоя нормализует активации по признакам.

Нормализация слоя вычисляется следующим образом:

\[ \text{LayerNorm}(\mathbf{x}) = \gamma \odot \frac{\mathbf{x} - \mu}{\sqrt{\sigma^2 + \epsilon}} + \beta \]где:

- \(\mu\) и \(\sigma\) — среднее значение и стандартное отклонение активаций по признакам

- \(\gamma\) и \(\beta\) — обучаемые параметры масштаба и сдвига

- \(\epsilon\) — малая константа для численной стабильности

- \(\odot\) — поэлементное умножение

Остаточные соединения

Остаточные соединения (Residual Connections) используются для улучшения градиентного потока через глубокие нейронные сети. Они добавляют входные данные подслоя к его выходным данным:

В современных архитектурах трансформеров часто используется модификация, известная как "Pre-LayerNorm", где нормализация слоя применяется перед подслоем, а не после:

Полная архитектура декодера

Полная архитектура декодера трансформера может быть представлена следующим образом:

Для каждого слоя \(l\) из \(L\) слоев:

\[ \mathbf{h}^{l}_i = \mathbf{h}^{l-1}_i + \text{MultiHeadAttention}(\text{LayerNorm}(\mathbf{h}^{l-1}_i)) \] \[ \mathbf{h}^{l}_i = \mathbf{h}^{l}_i + \text{FFN}(\text{LayerNorm}(\mathbf{h}^{l}_i)) \]где \(\mathbf{h}^{0}_i = \mathbf{x}_i\) — входной вектор для токена \(i\).

Параметры современных языковых моделей

Современные языковые модели характеризуются следующими параметрами:

- Количество параметров — общее количество обучаемых весов модели

- Размерность модели (\(d_{model}\)) — размерность векторов, представляющих токены

- Количество слоев (\(L\)) — количество повторяющихся блоков декодера

- Количество голов внимания (\(h\)) — количество параллельных механизмов внимания

- Размерность FFN (\(d_{ff}\)) — размерность скрытого слоя полносвязной сети

Примеры параметров для некоторых известных моделей:

| Модель | Параметры | Размерность модели | Слои | Головы внимания |

|---|---|---|---|---|

| GPT-2 Small | 124M | 768 | 12 | 12 |

| GPT-2 Medium | 355M | 1024 | 24 | 16 |

| GPT-2 Large | 774M | 1280 | 36 | 20 |

| GPT-2 XL | 1.5B | 1600 | 48 | 25 |

| GPT-3 | 175B | 12288 | 96 | 96 |

| Llama 2 7B | 7B | 4096 | 32 | 32 |

| Llama 2 70B | 70B | 8192 | 80 | 64 |

Вычислительная сложность

Вычислительная сложность трансформера определяется в основном механизмом внимания, который имеет квадратичную зависимость от длины последовательности:

Сложность самовнимания:

\[ O(n^2 \cdot d) \]где \(n\) — длина последовательности, а \(d\) — размерность модели.

Сложность полносвязной сети:

\[ O(n \cdot d^2) \]Эта квадратичная зависимость от длины последовательности является основным ограничением для обработки длинных текстов. Для решения этой проблемы разрабатываются различные методы эффективного внимания, такие как Sparse Attention, Longformer, Reformer и другие.

Внутреннее устройство нейросети определяет ее способности и ограничения. Понимание архитектуры трансформера и его компонентов позволяет эффективно использовать языковые модели и разрабатывать новые архитектуры для решения специфических задач.

5.1 Современные архитектуры: за пределами базовых трансформеров

Хотя базовая архитектура трансформера, описанная в статье "Attention Is All You Need" (2017), остается основой современных языковых моделей, в последние годы были разработаны значительные усовершенствования, которые позволили масштабировать модели до триллионов параметров и значительно улучшить их производительность.

Mixture of Experts (MoE)

Одной из наиболее значимых современных архитектурных инноваций является Mixture of Experts (MoE) — подход к разреженным нейронным сетям, который позволяет масштабировать модели до триллионов параметров без пропорционального увеличения вычислительных затрат.

Основная идея MoE заключается в следующем: вместо того чтобы активировать всю нейронную сеть для каждого входного токена, модель динамически выбирает только небольшое подмножество параметров ("экспертов") для обработки каждого токена.

Математически MoE-слой можно описать так:

\[ y = \sum_{i=1}^{n} G(x)_i \cdot E_i(x) \]где:

- \(x\) — входной вектор

- \(E_i\) — i-й эксперт (обычно полносвязная нейронная сеть)

- \(G(x)\) — функция маршрутизации, определяющая веса для каждого эксперта

- \(n\) — количество экспертов

- \(y\) — выходной вектор

Ключевые варианты и усовершенствования MoE:

- Switch Transformers (Google, 2021) — использование жесткой маршрутизации, где каждый токен направляется только к одному эксперту

- Sparse MoE (Google, 2022) — улучшенные алгоритмы балансировки нагрузки между экспертами

- Expert Choice Routing (Microsoft/Meta, 2023-2024) — вместо того чтобы токены выбирали экспертов, эксперты выбирают токены, что улучшает балансировку нагрузки

- Mixtral 8x7B (Mistral AI, 2023) — открытая модель с архитектурой MoE, где каждый слой содержит 8 экспертов, но для каждого токена активируется только 2

- Claude 3 Opus (Anthropic) и GPT-4 (OpenAI) — предположительно используют вариации MoE-архитектуры

Архитектура MoE позволяет значительно увеличить количество параметров модели (до триллионов) без пропорционального увеличения вычислительных затрат при инференсе, поскольку для каждого токена активируется лишь небольшая часть параметров. Это приводит к более эффективным моделям с точки зрения соотношения количества параметров к вычислительным затратам.

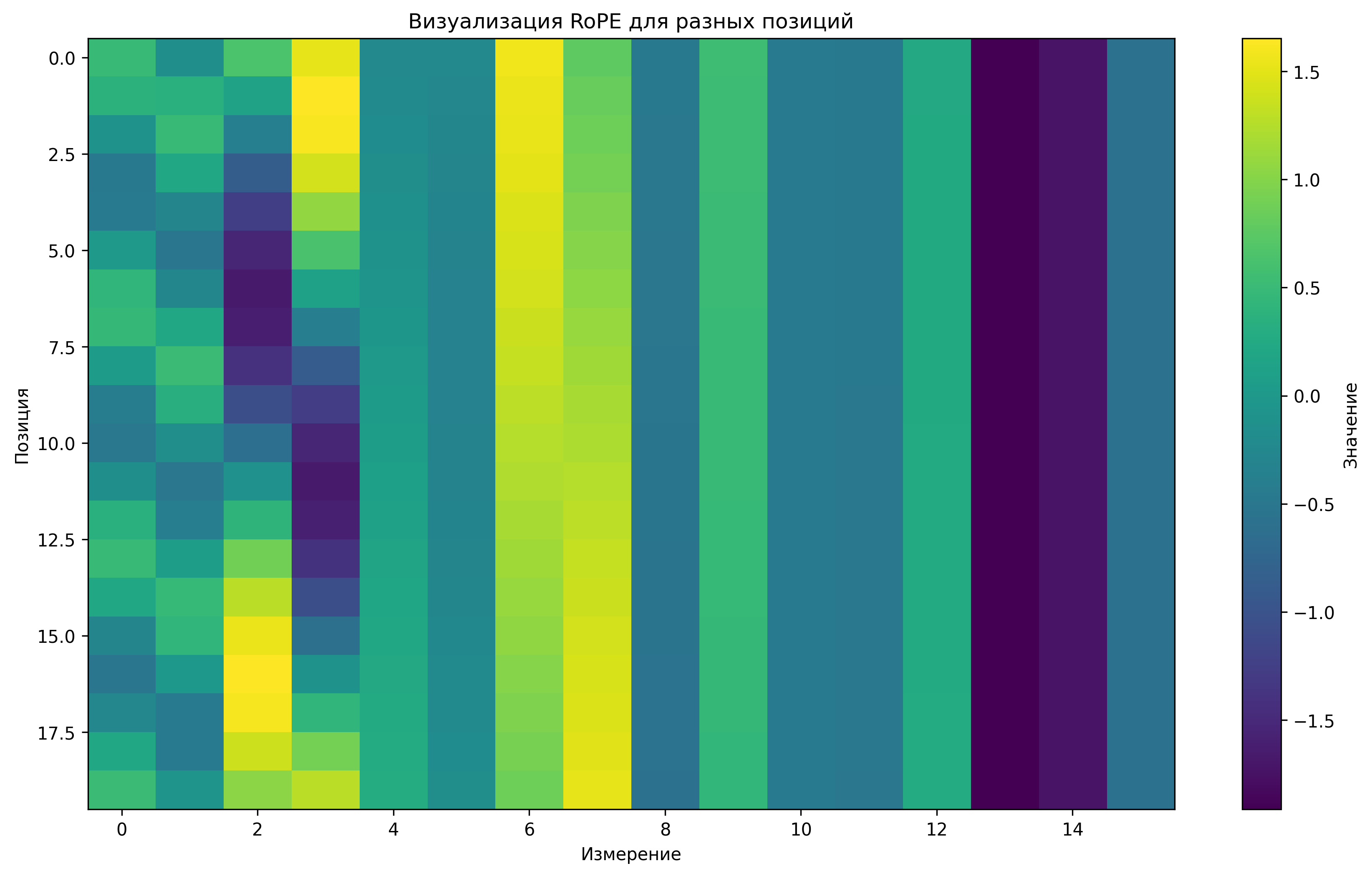

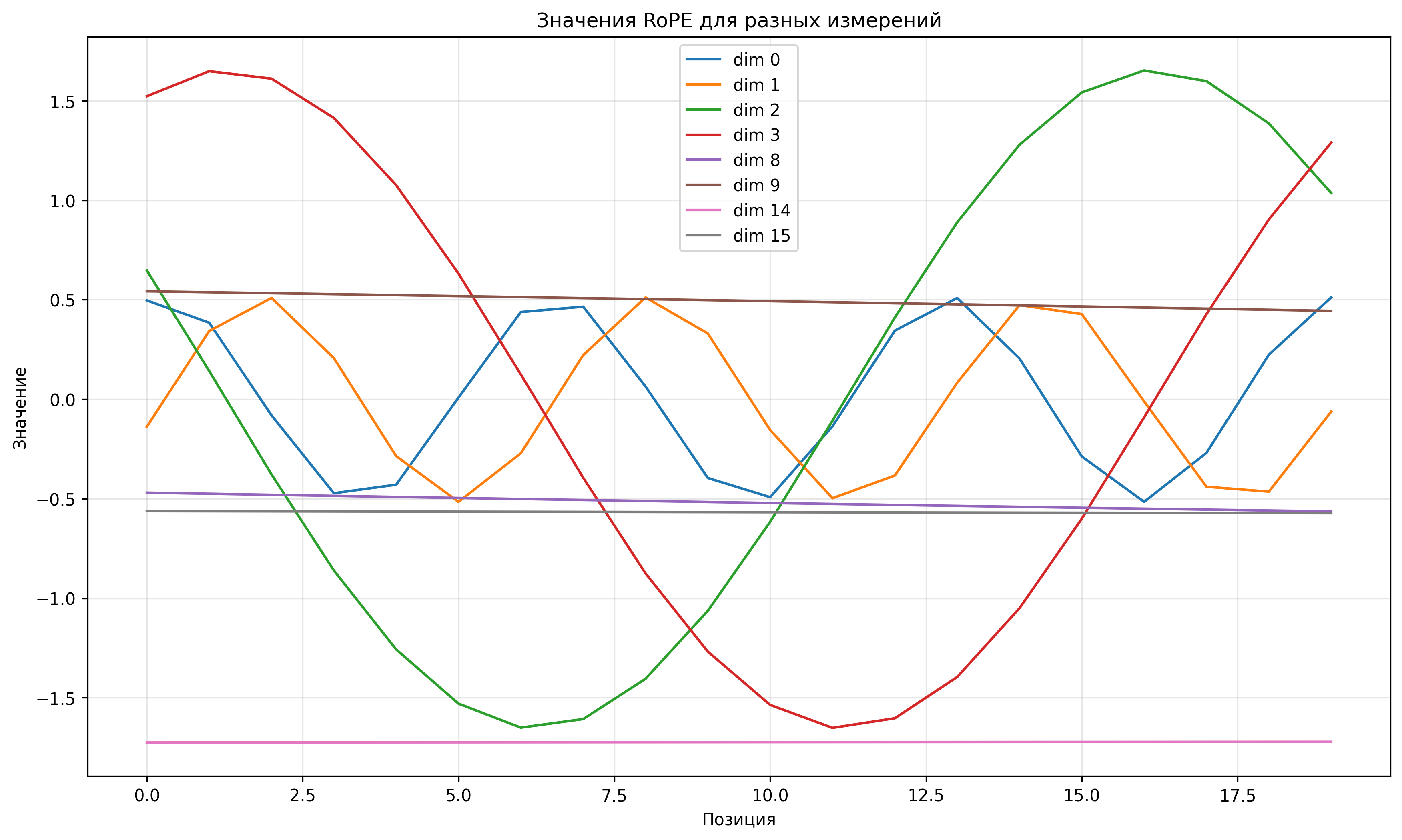

Rotary Position Embedding (RoPE)

Важным усовершенствованием трансформеров стал метод позиционного кодирования Rotary Position Embedding (RoPE), предложенный в 2021 году. RoPE использует математические свойства комплексных чисел для кодирования позиций токенов, что позволяет модели лучше понимать относительные позиции слов в тексте и экстраполировать на контексты длиннее, чем в обучающих данных.

RoPE применяет поворот в комплексной плоскости к каждому элементу векторов запросов и ключей:

\[ \mathbf{R}_{\theta, m}(x) = \begin{bmatrix} \cos m\theta & -\sin m\theta \\ \sin m\theta & \cos m\theta \end{bmatrix} \cdot \mathbf{x} \]где \(m\) — позиция токена, \(\theta\) — фиксированная константа, а \(\mathbf{x}\) — элемент вектора запроса или ключа.

RoPE используется во многих современных моделях, включая семейства Llama, Mistral, Gemma и др.

Multi-query Attention

Для ускорения инференса в современных моделях часто используется механизм Multi-query Attention (MQA) и его вариации. В отличие от классического мультиголового внимания, где для каждой головы внимания есть отдельные проекции запросов, ключей и значений, в MQA используется общий набор ключей и значений для всех голов, что значительно снижает объем вычислений и требуемую память.

Классическое мультиголовое внимание:

\[ \text{головы}_i = \text{Attention}(QW_i^Q, KW_i^K, VW_i^V) \]Multi-query Attention:

\[ \text{головы}_i = \text{Attention}(QW_i^Q, KW^K, VW^V) \]где \(W_i^Q\) — матрица проекции для запросов i-й головы, а \(W^K\) и \(W^V\) — общие матрицы проекций для ключей и значений.

Этот подход существенно снижает затраты памяти при инференсе, особенно с использованием KV-кэширования.

Sliding Window Attention

Для работы с длинным контекстом современные модели часто используют механизмы "скользящего окна" (sliding window attention), которые ограничивают внимание каждого токена только к определенному окну токенов вокруг него, что снижает вычислительную сложность с квадратичной до линейной относительно длины последовательности.

Формально, для токена в позиции \(i\), маска скользящего окна \(M\) определяется как:

\[ M_{i,j} = \begin{cases} 0 & \text{если } j \in [i - w, i] \\ -\infty & \text{иначе} \end{cases} \]где \(w\) — размер окна до текущей позиции.

Этот подход позволяет обрабатывать очень длинные последовательности (сотни тысяч токенов) без квадратичного роста вычислительных затрат и памяти.

Архитектуры для мультимодальных моделей

Современные мультимодальные модели, такие как GPT-4, Claude 3, Gemini, используют сложные архитектуры, объединяющие обработку текста, изображений, аудио и других модальностей. Ключевые инновации включают:

- Vision Transformers (ViT) — адаптация трансформеров для обработки изображений путем разбиения изображения на патчи

- Perceiver — архитектура, которая преобразует входные данные любой модальности в латентное представление фиксированной размерности

- CLIP/ALIGN — модели, обученные связывать текстовые и визуальные представления

- Fusion-in-Decoder (FiD) — архитектура для эффективного объединения информации из разных модальностей

Хотя архитектурные инновации значительно улучшили производительность моделей, важно понимать их фундаментальные ограничения. Масштабирование моделей с использованием MoE и других техник сталкивается с вызовами:

- Сложность обучения и балансировки нагрузки между экспертами

- Потенциальная нестабильность и непоследовательность в использовании экспертов

- Отсутствие теоретического обоснования для многих эвристик в архитектурных решениях

- Необходимость огромных вычислительных ресурсов для обучения, что ограничивает исследования небольшими организациями

Современные архитектурные решения продолжают быстро развиваться, и многие аспекты самых продвинутых моделей остаются закрытыми коммерческой тайной, что создает асимметрию знаний между крупными корпорациями и академическим сообществом.

6. Инференс

Инференс (вывод) — это процесс использования обученной модели для генерации текста или решения других задач. В этом разделе мы рассмотрим, как происходит инференс в современных языковых моделях, какие оптимизации применяются и с какими ограничениями приходится сталкиваться.

Автореггрессивная генерация

Языковые модели типа GPT используют автореггрессивный подход к генерации текста. Это означает, что модель генерирует текст последовательно, токен за токеном, используя ранее сгенерированные токены как контекст для предсказания следующего токена.

Формально, вероятность последовательности токенов \(x_1, x_2, \ldots, x_n\) моделируется как:

\[ P(x_1, x_2, \ldots, x_n) = \prod_{t=1}^{n} P(x_t | x_1, x_2, \ldots, x_{t-1}) \]При инференсе для каждой позиции \(t\) модель вычисляет распределение вероятностей для следующего токена:

\[ P(x_t | x_1, x_2, \ldots, x_{t-1}) \]Затем из этого распределения выбирается токен (с использованием различных стратегий сэмплирования, описанных ранее), и процесс повторяется для следующей позиции.

Этапы инференса

Процесс инференса в языковой модели можно разделить на следующие этапы:

- Токенизация входного текста — преобразование входного текста (промпта) в последовательность токенов

- Преобразование токенов в эмбеддинги — получение векторных представлений токенов

- Добавление позиционного кодирования — учет позиций токенов в последовательности

- Прямой проход через слои модели — обработка последовательности слоями трансформера

- Предсказание следующего токена — вычисление распределения вероятностей для следующего токена

- Сэмплирование — выбор конкретного токена из распределения вероятностей

- Повторение шагов 2-6 — для каждого нового токена, пока не будет достигнуто условие остановки

- Декодирование — преобразование последовательности токенов обратно в текст

Кэширование ключей и значений

Одна из важных оптимизаций при инференсе — кэширование ключей и значений (KV-caching). Поскольку при автореггрессивной генерации контекст постоянно растет, но предыдущие токены не меняются, можно сохранять вычисленные ключи и значения для каждого слоя и головы внимания, чтобы не пересчитывать их для каждого нового токена.

Для каждого слоя \(l\) и головы внимания \(h\) мы сохраняем:

\[ K^{l,h} = [k^{l,h}_1, k^{l,h}_2, \ldots, k^{l,h}_t] \] \[ V^{l,h} = [v^{l,h}_1, v^{l,h}_2, \ldots, v^{l,h}_t] \]При генерации токена \(t+1\) мы вычисляем только новые ключ и значение:

\[ k^{l,h}_{t+1} = x^l_{t+1} W^{K,l,h} \] \[ v^{l,h}_{t+1} = x^l_{t+1} W^{V,l,h} \]И добавляем их к кэшу:

\[ K^{l,h} = [k^{l,h}_1, k^{l,h}_2, \ldots, k^{l,h}_t, k^{l,h}_{t+1}] \] \[ V^{l,h} = [v^{l,h}_1, v^{l,h}_2, \ldots, v^{l,h}_t, v^{l,h}_{t+1}] \]Это значительно ускоряет инференс, особенно для длинных последовательностей, так как вместо \(O(t^2)\) операций для каждого нового токена требуется только \(O(t)\) операций.

def inference_with_kv_cache(model, prompt_tokens, max_length):

# Инициализация

tokens = prompt_tokens.copy()

# Инициализация KV-кэша

kv_cache = initialize_empty_kv_cache(model.num_layers, model.num_heads)

# Обработка всего промпта за один проход

logits, kv_cache = model.forward(tokens, kv_cache)

# Автореггрессивная генерация

for i in range(len(tokens), max_length):

# Получение распределения вероятностей для следующего токена

next_token_logits = logits[-1]

# Сэмплирование следующего токена

next_token = sample_token(next_token_logits)

# Добавление токена к последовательности

tokens.append(next_token)

# Проверка условия остановки

if is_stop_condition(tokens, next_token):

break

# Обработка только нового токена (с использованием KV-кэша)

logits, kv_cache = model.forward([next_token], kv_cache)

return tokens

def initialize_empty_kv_cache(num_layers, num_heads):

"""Инициализация пустого KV-кэша для всех слоев и голов внимания"""

kv_cache = []

for l in range(num_layers):

layer_cache = []

for h in range(num_heads):

# Для каждой головы внимания в каждом слое создаем пустые списки для ключей и значений

head_cache = {'keys': [], 'values': []}

layer_cache.append(head_cache)

kv_cache.append(layer_cache)

return kv_cache

Оптимизации инференса

Помимо KV-кэширования, существуют и другие оптимизации, которые применяются для ускорения инференса:

- Батчинг — обработка нескольких запросов одновременно для лучшего использования параллелизма

- Квантизация — уменьшение точности представления весов модели (например, с FP32 до INT8 или даже INT4)

- Прунинг — удаление малозначимых весов или целых компонентов модели

- Дистилляция — обучение меньшей модели имитировать поведение большей модели

- Специализированное аппаратное обеспечение — использование GPU, TPU или специализированных ASIC для ускорения матричных операций

Квантизация

Квантизация — это процесс уменьшения точности представления весов модели. Это позволяет значительно уменьшить размер модели и ускорить инференс, но может привести к некоторому снижению качества.

Простейшая форма квантизации — линейная квантизация, которая отображает значения из исходного диапазона в целевой диапазон:

\[ q = \text{round}\left(\frac{x - x_{\min}}{x_{\max} - x_{\min}} \cdot (2^b - 1)\right) \]где:

- \(x\) — исходное значение

- \(x_{\min}\) и \(x_{\max}\) — минимальное и максимальное значения в исходном диапазоне

- \(b\) — количество бит для представления квантизованных значений

- \(q\) — квантизованное значение

Для восстановления приближенного исходного значения используется обратная формула:

\[ \hat{x} = \frac{q}{2^b - 1} \cdot (x_{\max} - x_{\min}) + x_{\min} \]Существуют более сложные методы квантизации, такие как квантизация с учетом распределения весов, квантизация с обучением (Quantization-Aware Training) и другие.

Ограничения инференса

Инференс в языковых моделях сталкивается с рядом ограничений:

- Ограничение контекстного окна — максимальное количество токенов, которое модель может обрабатывать за один раз

- Вычислительная сложность — квадратичная зависимость от длины последовательности

- Память — требования к памяти для хранения активаций и KV-кэша

- Детерминизм — сложность обеспечения воспроизводимых результатов при использовании стохастических методов сэмплирования

- Латентность — задержка при генерации каждого нового токена

Расширение контекстного окна

Одно из важных направлений исследований — расширение контекстного окна модели. Существует несколько подходов:

- Позиционное кодирование для длинных последовательностей — разработка новых методов позиционного кодирования, которые лучше масштабируются на длинные последовательности

- Эффективные механизмы внимания — разработка механизмов внимания с линейной или логарифмической сложностью вместо квадратичной

- Рекуррентная обработка — использование рекуррентных механизмов для обработки длинных последовательностей по частям

- Сжатие контекста — методы для сжатия длинного контекста в более компактное представление

Инференс — это не просто применение обученной модели, а сложный процесс, требующий оптимизации и учета различных ограничений. Понимание этого процесса позволяет эффективно использовать языковые модели и разрабатывать новые методы для улучшения их производительности и возможностей.

Специализированное аппаратное обеспечение

Для эффективного инференса языковых моделей используется специализированное аппаратное обеспечение:

- GPU (Graphics Processing Units) — графические процессоры, оптимизированные для параллельных вычислений

- TPU (Tensor Processing Units) — специализированные процессоры Google для тензорных операций

- ASIC (Application-Specific Integrated Circuits) — специализированные интегральные схемы, разработанные для конкретных задач

- FPGA (Field-Programmable Gate Arrays) — программируемые логические матрицы, которые можно настроить для конкретных задач

Каждый тип аппаратного обеспечения имеет свои преимущества и недостатки с точки зрения производительности, энергоэффективности, гибкости и стоимости.

В следующем разделе мы рассмотрим конкретный пример — архитектуру и инференс модели GPT-2.

6.1. Эффективные механизмы внимания

Стандартный механизм внимания имеет квадратичную сложность O(n²) относительно длины последовательности, что становится критическим ограничением при обработке длинных текстов. В этом разделе мы рассмотрим современные подходы к оптимизации механизма внимания, которые позволяют эффективно работать с гораздо более длинными контекстами.

Проблема квадратичной сложности

Стандартный механизм внимания требует вычисления весов внимания между каждой парой токенов, что приводит к квадратичной сложности по памяти и вычислениям:

Для последовательности длины \(n\) и размерности модели \(d\):

- Вычислительная сложность: \(O(n^2 \cdot d)\)

- Сложность по памяти: \(O(n^2)\)

Эта квадратичная зависимость становится критической при обработке длинных текстов, например, для контекста в 32K токенов требуется хранить матрицу внимания размером 32K × 32K.

Sparse Attention (разреженное внимание)

Идея разреженного внимания заключается в том, что каждый токен взаимодействует только с подмножеством других токенов, а не со всеми. Это снижает сложность до \(O(n \cdot k)\), где \(k\) — среднее количество токенов, с которыми взаимодействует каждый токен.

Основные подходы к разреженному вниманию:

- Fixed patterns — использование предопределенных шаблонов разреженности (локальное внимание, разреженное внимание с шагом и т.д.)

- Learned patterns — обучение модели определять, какие связи важны

- Dynamic patterns — динамическое определение важных связей во время инференса

Longformer

Longformer — это архитектура, представленная в 2020 году, которая комбинирует локальное скользящее окно внимания с глобальным вниманием для избранных токенов. Это позволяет эффективно обрабатывать документы длиной до 4096 токенов.

Внимание в Longformer можно представить как:

\[ A_{ij} = \begin{cases} \frac{\exp(e_{ij})}{\sum_{k \in \mathcal{N}_i} \exp(e_{ik})} & \text{если } j \in \mathcal{N}_i \text{ или } j \in \mathcal{G} \\ 0 & \text{иначе} \end{cases} \]где \(\mathcal{N}_i\) — локальное окно вокруг токена \(i\), а \(\mathcal{G}\) — множество глобальных токенов.

Transformer-XL

Transformer-XL решает проблему ограниченного контекста, используя механизм рекуррентной передачи состояния между сегментами. Это позволяет модели учитывать более широкий контекст без квадратичного роста вычислительных затрат.

В Transformer-XL скрытые состояния предыдущего сегмента кэшируются и используются при обработке текущего сегмента:

\[ \widetilde{h}^{l-1}_t = [h^{l-1}_{t-1}; h^{l-1}_t] \] \[ q^l_t = W^Q_l h^{l-1}_t, \quad k^l_t = W^K_l \widetilde{h}^{l-1}_t, \quad v^l_t = W^V_l \widetilde{h}^{l-1}_t \]где \(h^{l-1}_{t-1}\) — кэшированные состояния из предыдущего сегмента.

Reformer

Reformer, представленный в 2020 году, использует два ключевых приема для оптимизации памяти и вычислений:

- Locality-Sensitive Hashing (LSH) — для эффективного поиска схожих ключей и запросов

- Обратимые остаточные слои — для экономии памяти при обратном проходе

LSH группирует схожие ключи и запросы вместе, что позволяет вычислять внимание только между элементами в одной группе, снижая сложность до \(O(n \log n)\).

LSH-внимание можно представить как:

\[ \text{LSH-Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T \odot M}{\sqrt{d_k}}\right)V \]где \(M\) — маска, определяемая LSH-хешированием, а \(\odot\) — поэлементное умножение.

FlashAttention

FlashAttention, представленный в 2022 году, — это алгоритмическая оптимизация, которая фокусируется на эффективном использовании иерархии памяти в современных GPU. Вместо того чтобы вычислять и хранить полную матрицу внимания, FlashAttention разбивает вычисления на блоки, которые помещаются в быструю SRAM-память (регистры и разделяемую память).

Основные оптимизации FlashAttention:

- Блочное вычисление внимания для лучшего использования кэш-памяти

- Переиспользование данных в быстрой памяти для уменьшения доступов к глобальной памяти

- Оптимизация алгоритма для стабильных численных вычислений

FlashAttention достигает существенного ускорения (до 3-5 раз) и уменьшения использования памяти по сравнению с наивной реализацией внимания, не жертвуя при этом точностью.

Вместо хранения полной матрицы внимания \(A \in \mathbb{R}^{n \times n}\), FlashAttention вычисляет выход по блокам:

\[ O = \text{softmax}(QK^T / \sqrt{d})V = D^{-1}AV \]где \(D\) — диагональная матрица с суммами строк \(A\), а вычисления выполняются блочно для тайлов матриц \(Q\), \(K\) и \(V\).

FlashAttention 2

FlashAttention 2 — улучшенная версия алгоритма, представленная в 2023 году, с еще большей оптимизацией операций и лучшим использованием параллелизма. Она достигает дополнительного ускорения на 2-4x по сравнению с оригинальным FlashAttention.

Multi-query и Grouped-query Attention

Multi-query Attention (MQA) и Grouped-query Attention (GQA) — это оптимизации, направленные на уменьшение размера KV-кэша при инференсе, что особенно важно для длинных последовательностей.

- MQA — использует уникальные запросы для каждой головы внимания, но общие ключи и значения для всех голов

- GQA — компромисс между MQA и стандартным многоголовым вниманием, где головы группируются, и каждая группа имеет свои ключи и значения

Стандартное многоголовое внимание:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h, \quad \mathbf{k}^h_i = \mathbf{x}_i W^K_h, \quad \mathbf{v}^h_i = \mathbf{x}_i W^V_h \]Multi-query Attention:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h, \quad \mathbf{k}_i = \mathbf{x}_i W^K, \quad \mathbf{v}_i = \mathbf{x}_i W^V \]Grouped-query Attention:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h, \quad \mathbf{k}^g_i = \mathbf{x}_i W^K_g, \quad \mathbf{v}^g_i = \mathbf{x}_i W^V_g \]где \(g\) — группа, к которой принадлежит голова \(h\).

Sliding Window Attention

Sliding Window Attention ограничивает поле зрения каждого токена локальным окном фиксированного размера, что линеаризует сложность вычислений и памяти относительно длины последовательности.

Для токена в позиции \(i\), маска скользящего окна \(M\) определяется как:

\[ M_{i,j} = \begin{cases} 0 & \text{если } |i-j| \leq w \\ -\infty & \text{иначе} \end{cases} \]где \(w\) — размер окна внимания.

Этот подход особенно эффективен для моделей с длинным контекстом, таких как Mistral и дообученные версии моделей Llama, которые могут обрабатывать сотни тысяч токенов.

Сравнение подходов к оптимизации внимания

| Метод | Сложность | Преимущества | Недостатки |

|---|---|---|---|

| Стандартное внимание | \(O(n^2 \cdot d)\) | Полная глобальная информация | Высокие требования к памяти и вычислениям |

| Sparse Attention | \(O(n \cdot k \cdot d)\) | Снижение вычислительных затрат | Потеря глобальной информации |

| Longformer | \(O(n \cdot w \cdot d)\) | Комбинация локального и глобального внимания | Сложная реализация |

| Reformer (LSH) | \(O(n \cdot \log n \cdot d)\) | Аппроксимация полного внимания | Сложные хеш-функции и потеря точности |

| FlashAttention | \(O(n^2 \cdot d)\) | Оптимизация для GPU и экономия памяти | Требует специализированной реализации |

| MQA/GQA | \(O(n^2 \cdot d)\) | Снижение требований к памяти для KV-кэша | Небольшая потеря качества |

| Sliding Window | \(O(n \cdot w \cdot d)\) | Линейная сложность | Ограниченный контекст для каждого токена |

Применение эффективных механизмов внимания в современных моделях

Современные языковые модели активно используют различные оптимизации механизма внимания:

- Llama 3 — использует GQA для оптимизации KV-кэша и FlashAttention для ускорения вычислений

- Mistral — комбинирует Sliding Window Attention с GQA для обработки длинных последовательностей

- Claude — предположительно использует комбинацию различных техник оптимизации внимания

- GLM — использует 2D Positional Encoding и Multi-Query Attention

С каждым новым поколением моделей появляются все более эффективные подходы к оптимизации механизма внимания, что позволяет обрабатывать более длинные контексты и снижать вычислительные затраты.

Эффективные механизмы внимания — это активная область исследований, которая постоянно развивается. Выбор конкретного метода зависит от специфики задачи, доступных вычислительных ресурсов и требований к качеству модели. Комбинирование различных подходов часто дает наилучшие результаты. Понимание этих механизмов позволяет более эффективно использовать языковые модели и создавать новые архитектуры для решения специфических задач.

7. GPT-2: обучение и инференс

В этом разделе мы рассмотрим конкретный пример языковой модели — GPT-2, разработанной OpenAI в 2019 году. Хотя эта модель уже не является самой современной, она хорошо документирована и представляет собой отличный пример для понимания принципов работы языковых моделей.

Архитектура GPT-2

GPT-2 (Generative Pre-trained Transformer 2) — это языковая модель, основанная на архитектуре трансформера, а точнее, на его декодерной части. Модель была выпущена в нескольких размерах:

- GPT-2 Small: 124 миллиона параметров

- GPT-2 Medium: 355 миллионов параметров

- GPT-2 Large: 774 миллиона параметров

- GPT-2 XL: 1.5 миллиарда параметров

Основные параметры архитектуры GPT-2 XL:

- Размерность модели (\(d_{model}\)): 1600

- Количество слоев: 48

- Количество голов внимания: 25

- Размерность FFN (\(d_{ff}\)): 6400

- Размер словаря: 50,257 токенов

- Максимальная длина последовательности: 1024 токена

Обучение GPT-2

GPT-2 была обучена на наборе данных WebText, который содержал около 40 ГБ текста из интернета. Обучение проходило в два этапа:

- Предобучение — обучение модели предсказывать следующий токен в последовательности на большом корпусе текстов

- Тонкая настройка — адаптация модели для конкретных задач (хотя для GPT-2 этот этап был минимальным, так как модель была предназначена для общего использования)

Функция потерь при обучении — это отрицательный логарифм правдоподобия:

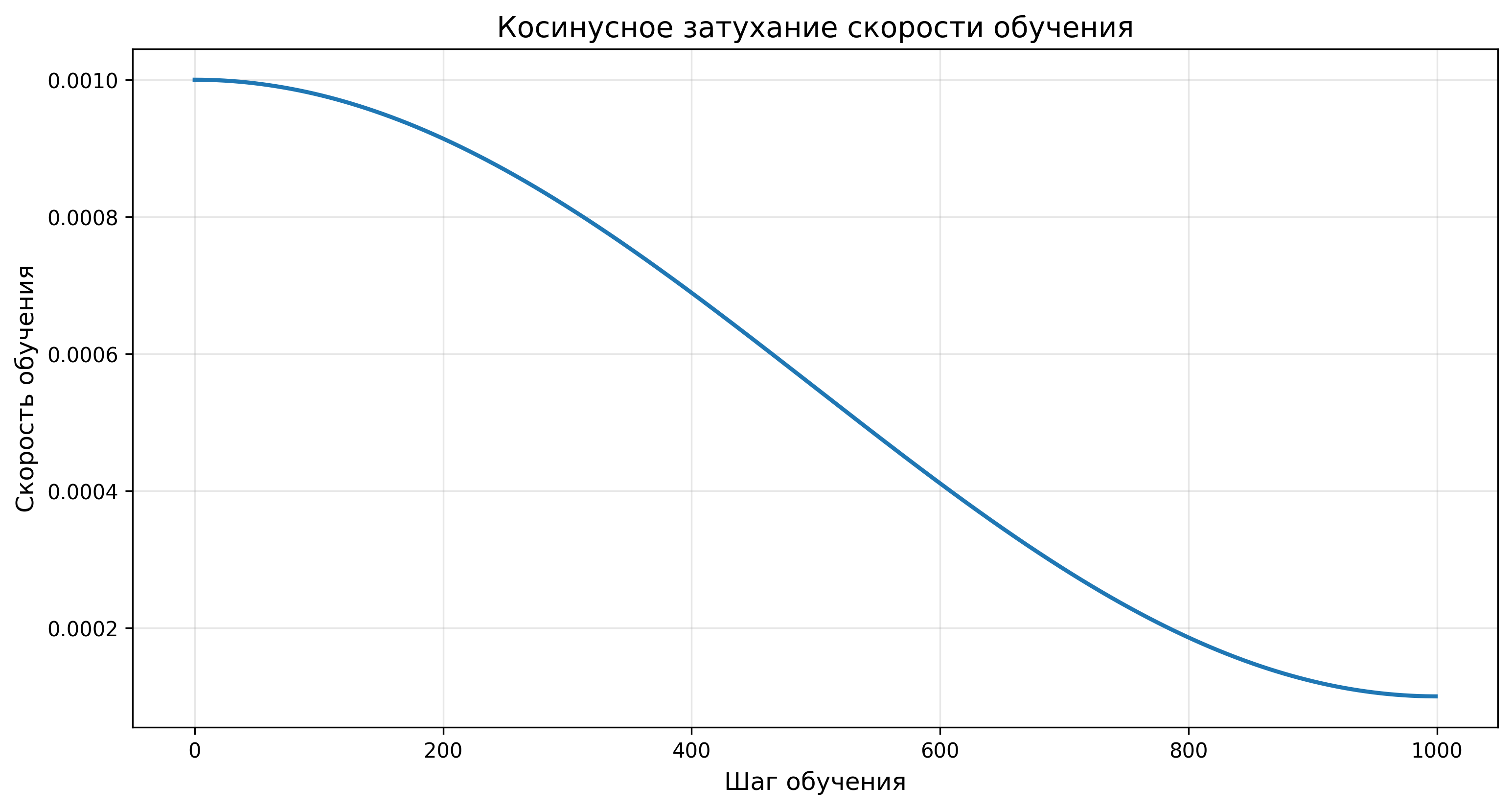

Для оптимизации использовался алгоритм Adam с косинусным затуханием скорости обучения:

где:

- \(\eta_t\) — скорость обучения на шаге \(t\)

- \(\eta_{\min}\) и \(\eta_{\max}\) — минимальная и максимальная скорость обучения

- \(T\) — общее количество шагов обучения

Токенизация в GPT-2

GPT-2 использует токенизатор на основе Byte-Pair Encoding (BPE), но с одним важным отличием: он работает на уровне байтов, а не символов. Это позволяет модели обрабатывать любой текст, независимо от языка или кодировки.

Процесс токенизации в GPT-2:

- Текст кодируется в UTF-8, получая последовательность байтов

- К каждому байту добавляется префикс, чтобы отличить его от многобайтовых токенов

- Применяется алгоритм BPE для объединения часто встречающихся пар байтов

- Полученные токены преобразуются в индексы словаря

Инференс в GPT-2

Процесс инференса в GPT-2 следует общей схеме, описанной в предыдущем разделе:

- Токенизация входного текста

- Преобразование токенов в эмбеддинги

- Добавление позиционного кодирования

- Прямой проход через слои модели

- Предсказание следующего токена

- Сэмплирование и повторение процесса

GPT-2 использует маскированное самовнимание, чтобы предотвратить "подглядывание" в будущие токены:

где \(M\) — маска, которая принимает значение \(-\infty\) для позиций, которые не должны учитываться (будущие токены).

Для генерации текста GPT-2 использует различные стратегии сэмплирования, включая Top-K, Top-p (nucleus) и сэмплирование с температурой.

import torch

from transformers import GPT2LMHeadModel, GPT2Tokenizer

def generate_text(prompt, max_length=100, temperature=0.7, top_k=0, top_p=0.9):

"""

Генерация текста с использованием модели GPT-2

Параметры:

- prompt: начальный текст

- max_length: максимальная длина генерируемого текста

- temperature: температура сэмплирования

- top_k: количество наиболее вероятных токенов для выбора (0 - отключено)

- top_p: порог вероятности для nucleus sampling (1.0 - отключено)

Возвращает:

- сгенерированный текст

"""

# Загрузка модели и токенизатора

tokenizer = GPT2Tokenizer.from_pretrained('gpt2')

model = GPT2LMHeadModel.from_pretrained('gpt2')

model.eval()

# Токенизация промпта

input_ids = tokenizer.encode(prompt, return_tensors='pt')

# Генерация текста

output = model.generate(

input_ids,

max_length=max_length,

temperature=temperature,

top_k=top_k,

top_p=top_p,

do_sample=True,

pad_token_id=tokenizer.eos_token_id

)

# Декодирование результата

generated_text = tokenizer.decode(output[0], skip_special_tokens=True)

return generated_text

# Пример использования

prompt = "Искусственный интеллект — это"

generated_text = generate_text(prompt)

print(generated_text)

Оптимизации инференса в GPT-2

Для оптимизации инференса в GPT-2 применяются различные техники:

- KV-кэширование — сохранение ключей и значений для каждого слоя и головы внимания

- Батчинг — обработка нескольких запросов одновременно

- Квантизация — уменьшение точности представления весов модели

- Оптимизация графа вычислений — слияние операций, удаление ненужных операций

- Специализированные реализации для конкретных аппаратных платформ — оптимизация для GPU, TPU и т.д.

Производительность GPT-2

Производительность GPT-2 зависит от размера модели и аппаратного обеспечения. Вот примерные показатели для различных размеров модели на GPU NVIDIA V100:

| Модель | Параметры | Скорость генерации (токены/сек) | Память GPU |

|---|---|---|---|

| GPT-2 Small | 124M | ~30 | ~1 ГБ |

| GPT-2 Medium | 355M | ~15 | ~2 ГБ |

| GPT-2 Large | 774M | ~8 | ~4 ГБ |

| GPT-2 XL | 1.5B | ~4 | ~8 ГБ |

Эти показатели могут значительно варьироваться в зависимости от конкретной реализации, оптимизаций и аппаратного обеспечения.

Ограничения GPT-2

Несмотря на свои впечатляющие возможности, GPT-2 имеет ряд ограничений:

- Ограниченный контекст — модель может обрабатывать только 1024 токена за раз

- Отсутствие знаний о мире после обучения — модель не может знать о событиях, произошедших после ее обучения

- Склонность к повторениям — модель может зацикливаться и повторять одни и те же фразы

- Проблемы с длинными рассуждениями — модель может терять нить рассуждения в длинных текстах

- Галлюцинации — генерация фактически неверной информации с уверенным тоном

GPT-2 представляет собой важную веху в развитии языковых моделей. Хотя сейчас существуют более мощные модели, принципы, лежащие в основе GPT-2, остаются актуальными и для современных моделей. Понимание архитектуры и процесса инференса GPT-2 дает хорошую основу для работы с более сложными моделями, такими как GPT-3, GPT-4, Llama и другими.

В следующем разделе мы рассмотрим более современную модель — Llama 3.1, и особенности ее архитектуры и инференса.

8. Инференс базовой модели Llama 3.1

В этом разделе мы рассмотрим более современную языковую модель — Llama 3.1, разработанную Meta AI. Эта модель представляет собой значительный шаг вперед по сравнению с GPT-2 и демонстрирует современные подходы к архитектуре и инференсу языковых моделей.

Архитектура Llama 3.1

Llama 3.1 — это семейство языковых моделей, выпущенных в нескольких размерах:

- Llama 3.1 8B: 8 миллиардов параметров

- Llama 3.1 70B: 70 миллиардов параметров

- Llama 3.1 405B: 405 миллиардов параметров

Основные параметры архитектуры Llama 3.1 70B:

- Размерность модели (\(d_{model}\)): 8192

- Количество слоев: 80

- Количество голов внимания: 64

- Размер словаря: 128K токенов

- Максимальная длина последовательности: 128K токенов

Ключевые особенности архитектуры Llama 3.1

Llama 3.1 включает несколько архитектурных инноваций по сравнению с предыдущими моделями:

- Grouped-Query Attention (GQA) — модификация многоголового внимания, где несколько запросов (queries) используют одни и те же ключи и значения, что снижает вычислительную сложность и требования к памяти

- RoPE (Rotary Positional Embedding) — альтернативный метод позиционного кодирования, который лучше обобщается на последовательности, длиннее тех, что использовались при обучении

- SwiGLU активация — улучшенная функция активации для FFN, которая обеспечивает лучшую производительность

- RMSNorm — более эффективная альтернатива LayerNorm

Grouped-Query Attention (GQA)

GQA — это оптимизация механизма внимания, которая значительно снижает требования к памяти при инференсе, особенно для длинных последовательностей.

В стандартном многоголовом внимании каждая голова имеет свои матрицы запросов, ключей и значений:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h \] \[ \mathbf{k}^h_i = \mathbf{x}_i W^K_h \] \[ \mathbf{v}^h_i = \mathbf{x}_i W^V_h \]В GQA головы внимания объединяются в группы, и все головы в группе используют одни и те же ключи и значения:

\[ \mathbf{q}^h_i = \mathbf{x}_i W^Q_h \] \[ \mathbf{k}^g_i = \mathbf{x}_i W^K_g \] \[ \mathbf{v}^g_i = \mathbf{x}_i W^V_g \]где \(g\) — индекс группы, к которой принадлежит голова \(h\).

Это значительно уменьшает размер KV-кэша, что особенно важно для длинных последовательностей.

RoPE (Rotary Positional Embedding)

RoPE — это метод позиционного кодирования, который применяет вращение к векторам запросов и ключей в зависимости от их позиции в последовательности.

Для каждой пары измерений \((2i, 2i+1)\) в векторах запросов и ключей применяется вращение:

\[ \begin{pmatrix} q_{m,2i} \\ q_{m,2i+1} \end{pmatrix} \rightarrow \begin{pmatrix} \cos(m\theta_i) & -\sin(m\theta_i) \\ \sin(m\theta_i) & \cos(m\theta_i) \end{pmatrix} \begin{pmatrix} q_{m,2i} \\ q_{m,2i+1} \end{pmatrix} \] \[ \begin{pmatrix} k_{n,2i} \\ k_{n,2i+1} \end{pmatrix} \rightarrow \begin{pmatrix} \cos(n\theta_i) & -\sin(n\theta_i) \\ \sin(n\theta_i) & \cos(n\theta_i) \end{pmatrix} \begin{pmatrix} k_{n,2i} \\ k_{n,2i+1} \end{pmatrix} \]где:

- \(m\) и \(n\) — позиции токенов

- \(\theta_i = 10000^{-2i/d}\) — базовая частота для измерения \(i\)

- \(d\) — размерность векторов запросов и ключей

RoPE имеет несколько преимуществ:

- Лучшее обобщение на последовательности, длиннее тех, что использовались при обучении

- Сохранение относительных позиций в механизме внимания

- Более эффективная реализация

SwiGLU активация

SwiGLU — это улучшенная функция активации для FFN, которая обеспечивает лучшую производительность по сравнению с ReLU или GELU.

SwiGLU определяется следующим образом:

\[ \text{SwiGLU}(x, W, V, b, c) = \text{Swish}_{\beta}(xW + b) \otimes (xV + c) \]где \(\text{Swish}_{\beta}(x) = x \cdot \sigma(\beta x)\), а \(\sigma\) — сигмоидная функция.

В контексте FFN в трансформере:

\[ \text{FFN}(\mathbf{x}) = \text{SwiGLU}(\mathbf{x}W_1, \mathbf{x}W_2, \mathbf{b}_1, \mathbf{c})W_3 + \mathbf{b}_3 \]RMSNorm

RMSNorm (Root Mean Square Layer Normalization) — это более эффективная альтернатива LayerNorm, которая нормализует активации только по их среднеквадратичному значению, без центрирования.

RMSNorm вычисляется следующим образом:

\[ \text{RMSNorm}(\mathbf{x}) = \frac{\mathbf{x}}{\sqrt{\frac{1}{n}\sum_{i=1}^{n}x_i^2 + \epsilon}} \odot \mathbf{g} \]где:

- \(\mathbf{g}\) — обучаемый параметр масштаба

- \(\epsilon\) — малая константа для численной стабильности

- \(n\) — размерность вектора \(\mathbf{x}\)

RMSNorm имеет несколько преимуществ по сравнению с LayerNorm:

- Более эффективная вычислительная реализация

- Лучшая стабильность обучения

- Сохранение информации о знаке активаций

Инференс в Llama 3.1

Процесс инференса в Llama 3.1 следует общей схеме, описанной ранее, но с некоторыми оптимизациями:

- Токенизация входного текста с использованием SentencePiece

- Преобразование токенов в эмбеддинги

- Применение RoPE для позиционного кодирования

- Прямой проход через слои модели с использованием GQA

- Предсказание следующего токена

- Сэмплирование и повторение процесса

Благодаря GQA, Llama 3.1 имеет значительно меньший размер KV-кэша по сравнению с моделями, использующими стандартное многоголовое внимание, что позволяет эффективно обрабатывать длинные последовательности.

Оптимизации инференса в Llama 3.1

Для оптимизации инференса в Llama 3.1 применяются различные техники:

- KV-кэширование с GQA — уменьшение размера кэша за счет группировки голов внимания

- Квантизация — уменьшение точности представления весов модели (4-битная и 8-битная квантизация)

- Специализированные реализации — оптимизированные реализации для различных аппаратных платформ

- Распределенный инференс — распределение вычислений между несколькими устройствами

- Специализированные ядра — оптимизированные реализации ключевых операций (например, FlashAttention)

FlashAttention

FlashAttention — это оптимизированная реализация механизма внимания, которая значительно ускоряет вычисления и уменьшает использование памяти.

Основные оптимизации FlashAttention:

- Разбиение матриц на блоки для лучшего использования кэша GPU

- Переупорядочивание операций для минимизации доступа к глобальной памяти

- Использование смешанной точности для ускорения вычислений

- Оптимизация для разреженных матриц внимания

Стандартный механизм внимания требует \(O(n^2)\) памяти для хранения матрицы весов внимания размером \(n \times n\). FlashAttention уменьшает это до \(O(n)\), вычисляя веса внимания блоками и не сохраняя полную матрицу в памяти.

Квантизация в Llama 3.1

Для Llama 3.1 разработаны эффективные методы квантизации, которые позволяют значительно уменьшить размер модели с минимальной потерей качества:

- GPTQ — метод квантизации, основанный на оптимизации ошибки квантизации

- AWQ — адаптивная квантизация весов, которая учитывает важность различных весов

- QLoRA — метод дообучения квантизованных моделей с использованием низкоранговых адаптеров

Эти методы позволяют запускать Llama 3.1 70B на потребительских GPU с 24-32 ГБ памяти, что делает модель доступной для более широкого круга пользователей.

Llama 3.1 представляет собой современную языковую модель, которая включает множество архитектурных инноваций и оптимизаций для эффективного инференса. Понимание этих особенностей позволяет эффективно использовать модель и разрабатывать новые методы для улучшения ее производительности и возможностей.

В следующем разделе мы рассмотрим переход от предобучения к постобучению, который является важным этапом в создании современных языковых моделей.

9. От предобучения к постобучению

В этом разделе мы рассмотрим важный переход от предобучения (pre-training) к постобучению (post-training) языковых моделей. Этот переход является ключевым для создания моделей, которые не только обладают общими языковыми знаниями, но и могут эффективно решать конкретные задачи и следовать инструкциям пользователей.

Ограничения предобученных моделей

Предобученные языковые модели, такие как базовые версии GPT или Llama, обладают рядом ограничений:

- Отсутствие целенаправленности — модели обучены предсказывать следующий токен, но не решать конкретные задачи

- Проблемы с следованием инструкциям — модели могут игнорировать или неправильно интерпретировать инструкции пользователя

- Токсичность и предвзятость — модели могут генерировать неприемлемый контент, отражающий предвзятости в обучающих данных

- Галлюцинации — генерация фактически неверной информации с уверенным тоном

- Отсутствие специализации — модели не оптимизированы для конкретных доменов или задач

Для преодоления этих ограничений применяются различные методы постобучения.

Методы постобучения

Основные методы постобучения языковых моделей включают:

- Дообучение на специализированных данных (Fine-tuning) — дообучение модели на данных, специфичных для конкретной задачи или домена

- Обучение с подкреплением на основе обратной связи от человека (RLHF) — использование обратной связи от людей для обучения модели генерировать более полезные и безопасные ответы

- Обучение с подкреплением на основе обратной связи от модели (RLAIF) — использование другой модели для оценки и обратной связи

- Инструктивное дообучение (Instruction Tuning) — дообучение модели на парах инструкция-ответ для улучшения способности следовать инструкциям

- Конституционное ИИ (Constitutional AI) — обучение модели следовать набору принципов или "конституции"

Дообучение на специализированных данных (Fine-tuning)

Дообучение — это процесс дальнейшего обучения предварительно обученной модели на новом наборе данных, обычно меньшего размера и более специализированном.

Функция потерь при дообучении аналогична функции потерь при предобучении:

\[ \mathcal{L}_{FT} = -\frac{1}{N} \sum_{i=1}^{N} \log P(y_i | x_i, \theta) \]где:

- \(x_i\) — входные данные (например, запрос или инструкция)

- \(y_i\) — целевой выход (например, ответ или решение)

- \(\theta\) — параметры модели

- \(N\) — количество примеров в наборе данных для дообучения

Дообучение обычно проводится с меньшей скоростью обучения, чтобы не "забыть" знания, полученные при предобучении.

Инструктивное дообучение (Instruction Tuning)

Инструктивное дообучение — это специализированная форма дообучения, направленная на улучшение способности модели следовать инструкциям пользователя.

Данные для инструктивного дообучения обычно имеют формат:

Инструкция: [инструкция пользователя]

Ответ: [желаемый ответ модели]

Примеры инструкций могут включать:

- "Напиши стихотворение о весне"

- "Объясни теорию относительности простыми словами"

- "Суммируй следующий текст в трех предложениях"

- "Переведи этот текст на французский язык"

Инструктивное дообучение значительно улучшает способность модели понимать и выполнять разнообразные задачи, даже если они не были явно представлены в данных предобучения.

import json

def create_instruction_dataset(instructions_with_responses, output_file):

"""

Создание набора данных для инструктивного дообучения

Параметры:

- instructions_with_responses: список пар (инструкция, ответ)

- output_file: путь к выходному файлу

"""

dataset = []

for instruction, response in instructions_with_responses:

# Формирование примера в формате для дообучения

example = {

"instruction": instruction,

"response": response

}

dataset.append(example)

# Сохранение набора данных в формате JSONL

with open(output_file, 'w', encoding='utf-8') as f:

for example in dataset:

f.write(json.dumps(example, ensure_ascii=False) + '\n')

print(f"Создан набор данных с {len(dataset)} примерами")

# Пример использования

instructions_with_responses = [

(

"Напиши стихотворение о весне в стиле Пушкина.",

"Весна, весна! Как воздух чист!\nКак ясен небосклон!\nСвоей лазурию живой\nСлепит мне очи он.\n\nВесна, весна! Как высоко\nНа крыльях ветерка,\nЛаская взоры и цветя,\nЛетают облака!"

),

(

"Объясни концепцию квантовой запутанности простыми словами.",

"Квантовая запутанность — это явление, когда две частицы становятся связанными таким образом, что состояние одной мгновенно влияет на состояние другой, независимо от расстояния между ними. Представьте, что у вас есть две монеты в разных концах Вселенной. Если они квантово запутаны, то когда одна выпадает орлом, другая всегда будет решкой, и наоборот. Это происходит мгновенно, без передачи информации между ними, что Эйнштейн называл \"жутким действием на расстоянии\"."

),

(

"Напиши программу на Python, которая находит все простые числа до 100.",

"```python\ndef find_primes(n):\n \"\"\"Находит все простые числа до n с помощью решета Эратосфена\"\"\"\n # Инициализация списка потенциальных простых чисел\n sieve = [True] * (n + 1)\n sieve[0] = sieve[1] = False # 0 и 1 не являются простыми\n \n # Основной алгоритм решета\n for i in range(2, int(n**0.5) + 1):\n if sieve[i]:\n # Вычеркиваем все кратные i\n for j in range(i*i, n + 1, i):\n sieve[j] = False\n \n # Собираем все простые числа\n primes = [i for i in range(2, n + 1) if sieve[i]]\n return primes\n\n# Находим все простые числа до 100\nprimes = find_primes(100)\nprint(primes)\n```"

)

]

create_instruction_dataset(instructions_with_responses, "instruction_dataset.jsonl")

Обучение с подкреплением на основе обратной связи от человека (RLHF)

RLHF (Reinforcement Learning from Human Feedback) — это метод, который использует обратную связь от людей для обучения модели генерировать более полезные, точные и безопасные ответы.

Процесс RLHF обычно включает три основных этапа:

- Сбор данных о предпочтениях — люди оценивают различные ответы модели, указывая, какие из них лучше

- Обучение модели-вознаграждения — на основе собранных данных обучается модель, которая предсказывает, насколько хорошим будет ответ

- Оптимизация политики с помощью RL — языковая модель оптимизируется для максимизации вознаграждения, предсказанного моделью-вознаграждения

Функция потерь при RLHF обычно включает два компонента:

\[ \mathcal{L}_{RLHF} = \mathcal{L}_{RL} + \beta \mathcal{L}_{KL} \]где:

- \(\mathcal{L}_{RL}\) — потери от обучения с подкреплением (обычно отрицательное ожидаемое вознаграждение)

- \(\mathcal{L}_{KL}\) — дивергенция Кульбака-Лейблера между новой и исходной политикой (для предотвращения слишком сильного отклонения от исходной модели)

- \(\beta\) — коэффициент, контролирующий баланс между максимизацией вознаграждения и сохранением исходного поведения

Для оптимизации политики часто используется алгоритм Proximal Policy Optimization (PPO), который обеспечивает стабильное обучение.

Конституционное ИИ (Constitutional AI)

Конституционное ИИ — это подход, разработанный Anthropic для создания полезных, безопасных и честных ИИ-ассистентов. Он основан на обучении модели следовать набору принципов или "конституции".

Процесс создания конституционного ИИ включает:

- Определение конституции — набора принципов, которым должна следовать модель

- Самокритика — модель сама оценивает свои ответы на соответствие конституции

- Самоисправление — модель исправляет свои ответы, чтобы они соответствовали конституции

- RLHF с использованием самоисправленных ответов — обучение модели предпочитать исправленные ответы

Этот подход позволяет уменьшить зависимость от человеческой обратной связи и создать более масштабируемый процесс обучения.

Сравнение методов постобучения

Каждый метод постобучения имеет свои преимущества и недостатки:

| Метод | Преимущества | Недостатки |

|---|---|---|

| Fine-tuning |

|

|

| Instruction Tuning |

|

|

| RLHF |

|

|

| Constitutional AI |

|

|

Переход от предобучения к постобучению является критически важным для создания полезных и безопасных языковых моделей. Современные модели, такие как ChatGPT, Claude или Llama 3.1, используют комбинацию различных методов постобучения для достижения наилучших результатов. Понимание этих методов позволяет эффективно адаптировать и настраивать модели для конкретных задач и требований.

В следующем разделе мы рассмотрим данные, используемые для постобучения, и их особенности.

10. Данные постобучения (диалоги)

В этом разделе мы рассмотрим данные, используемые для постобучения языковых моделей, особенно диалоговые данные, которые играют ключевую роль в создании моделей-ассистентов, способных эффективно взаимодействовать с пользователями.

Типы данных для постобучения

Для постобучения языковых моделей используются различные типы данных:

- Инструктивные данные — пары инструкция-ответ, где модель учится выполнять конкретные задачи по инструкции

- Диалоговые данные — многоходовые диалоги между человеком и ассистентом

- Данные о предпочтениях — сравнительные оценки различных ответов модели

- Специализированные данные — данные для конкретных доменов или задач (медицина, право, программирование и т.д.)

- Данные для безопасности — примеры опасных запросов и безопасных ответов на них

Диалоговые данные

Диалоговые данные особенно важны для создания моделей-ассистентов, так как они учат модель поддерживать естественную и полезную беседу с пользователем.

Структура диалоговых данных обычно включает:

- Контекст — информация о ситуации или предыдущих взаимодействиях

- Сообщения пользователя — запросы, вопросы или инструкции от пользователя

- Сообщения ассистента — ответы, которые модель должна научиться генерировать

- Метаданные — дополнительная информация о диалоге (тема, оценка качества и т.д.)

{

"id": "dialog_12345",

"context": "Пользователь хочет узнать о нейронных сетях",

"messages": [

{

"role": "user",

"content": "Привет! Можешь объяснить, что такое нейронные сети?"

},

{

"role": "assistant",

"content": "Конечно! Нейронные сети — это вычислительные системы, вдохновленные биологическими нейронными сетями в мозге животных. Они состоят из искусственных нейронов, соединенных между собой, и способны обучаться на примерах, распознавать паттерны и делать предсказания. Нейронные сети лежат в основе многих современных систем искусственного интеллекта. Хотите узнать о каком-то конкретном аспекте нейронных сетей?"

},

{

"role": "user",

"content": "Да, расскажи о глубоком обучении и чем оно отличается от обычных нейронных сетей."

},

{

"role": "assistant",

"content": "Глубокое обучение — это подраздел машинного обучения, который использует нейронные сети с множеством слоев (глубокие нейронные сети). \n\nОсновные отличия глубокого обучения от традиционных нейронных сетей:\n\n1. Количество слоев: Традиционные нейронные сети обычно имеют 2-3 слоя, в то время как глубокие сети могут содержать десятки или даже сотни слоев.\n\n2. Автоматическое извлечение признаков: Глубокие сети автоматически извлекают иерархические признаки из данных, в то время как для традиционных сетей часто требуется ручное конструирование признаков.\n\n3. Вычислительные требования: Глубокие сети требуют значительно больше вычислительных ресурсов и данных для обучения.\n\n4. Производительность: Глубокие сети обычно показывают лучшие результаты на сложных задачах, таких как распознавание изображений, обработка естественного языка и игры.\n\nПрорыв в глубоком обучении произошел в 2012 году, когда сеть AlexNet выиграла соревнование по распознаванию изображений ImageNet, значительно превзойдя традиционные методы."

}

],

"metadata": {

"topic": "artificial_intelligence",

"quality_rating": 4.8,

"language": "ru",

"source": "synthetic"

}

}

Источники диалоговых данных

Диалоговые данные для постобучения могут быть получены из различных источников:

- Реальные диалоги — записи реальных взаимодействий между людьми и ассистентами

- Синтетические диалоги — диалоги, сгенерированные с помощью других моделей или специальных алгоритмов

- Краудсорсинг — диалоги, созданные специально нанятыми аннотаторами

- Существующие наборы данных — публично доступные наборы диалоговых данных

- Самообучение — диалоги, созданные самой моделью и отфильтрованные или улучшенные с помощью различных методов

Синтетические диалоговые данные

Синтетические диалоговые данные играют все более важную роль в постобучении, так как они позволяют создавать большие объемы разнообразных данных без необходимости сбора реальных взаимодействий.

Методы создания синтетических диалогов включают:

- Генерация с помощью более мощных моделей — использование более продвинутых моделей для создания обучающих данных для менее мощных моделей

- Самоинструктирование — модель сама генерирует инструкции и ответы на них

- Ролевые игры — модель играет роли как пользователя, так и ассистента

- Расширение существующих данных — создание вариаций существующих диалогов

import json

import random

from typing import List, Dict, Any

def generate_synthetic_dialog(topics: List[str], difficulty_levels: List[str]) -> Dict[str, Any]:

"""

Генерация синтетического диалога на заданную тему с заданным уровнем сложности

Параметры:

- topics: список возможных тем

- difficulty_levels: список уровней сложности

Возвращает:

- словарь с синтетическим диалогом

"""

# Выбор случайной темы и уровня сложности

topic = random.choice(topics)

difficulty = random.choice(difficulty_levels)

# Генерация идентификатора диалога

dialog_id = f"dialog_{random.randint(10000, 99999)}"

# Генерация контекста

context = f"Пользователь интересуется темой '{topic}' на уровне '{difficulty}'"

# Генерация первого сообщения пользователя

first_user_messages = [

f"Привет! Можешь рассказать о {topic}?",

f"Здравствуй! Я хочу узнать больше о {topic}.",

f"Добрый день! Мне нужна информация о {topic}.",

f"Привет! Я новичок в {topic}. Можешь объяснить основы?",

f"Здравствуйте! Я изучаю {topic}. Можешь помочь разобраться?"

]

first_user_message = random.choice(first_user_messages)

# Здесь должна быть логика для генерации ответа ассистента и последующих сообщений

# В реальном сценарии это может быть вызов языковой модели

# Для примера используем заглушки

assistant_response = f"Конечно! {topic} — это важная область знаний. [Подробное объяснение темы {topic} на уровне {difficulty}]"

follow_up_questions = [

f"А какие есть практические применения {topic}?",

f"Можешь привести примеры использования {topic} в реальной жизни?",

f"Какие есть последние достижения в области {topic}?",

f"Какие навыки нужны, чтобы стать экспертом в {topic}?",

f"Какие ресурсы ты рекомендуешь для дальнейшего изучения {topic}?"

]